一、引言

自然語言生成(又稱為文本生成)旨在基于輸入數據用人類語言生成合理且可讀的文本。隨著預訓練語言模型的發展,GPT-3,BART等模型逐漸成為了生成任務的主流模型。近年來,為了利用預訓練階段編碼的豐富知識,提示學習成為了一個簡單而強大的方法。

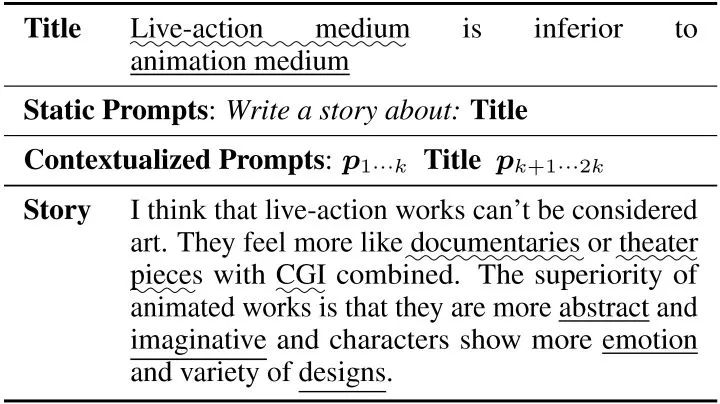

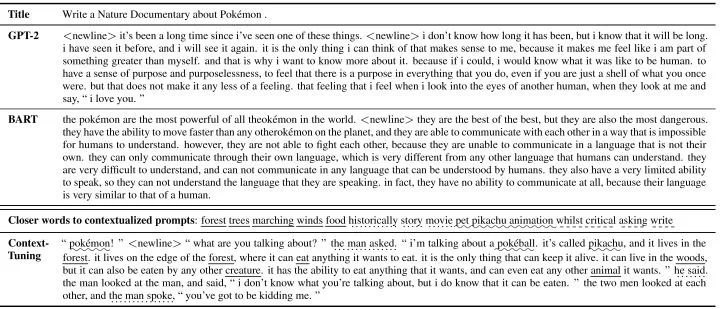

這篇工作主要聚焦于開放式文本生成,例如故事生成和評論生成。在這種場景下,輸入僅包含有限的信息,而任務目標是要生成富含信息量且與主題相關的長文本。例如下表中的例子,我們需要寫一段關于“live-action”和“animation”的評論,這需要對這兩個主題的背景信息有深入的了解。現有的提示學習方法,會在輸入前加上人工的離散提示(例如表中的“Write a story about:”),或者在輸入前加上可學習的連續型提示。但是這些提示是靜態的,更多是包含任務相關的信息,但與輸入無關,很難依靠他們去生成富含信息量的文本。

同時在長文本生成中,一個常見的問題是“跑題”,即生成的文本逐漸和主題無關。為了解決以上兩個問題,我們分別提出了語境提示(contextualized prompts)和連續反向提示(continuous inverse prompting),來增強生成文本的信息量和相關性。

二、語境調優(Context-Tuning)

本文提出了一種創新的連續提示方法,稱語境調優,用于微調預訓練模型來進行自然語言生成,我們的核心貢獻有三點:①我們首次提出了輸入相關的提示——語境提示,抽取預訓練模型中的知識作為提示來豐富生成文本的信息量。②我們使用了連續反向提示,最大化基于輸出生成輸入的概率,來增強生成文本的相關性。③我們使用了一種輕量化的語境調優方法,在只微調0.12%參數的情況下保持98%的性能。

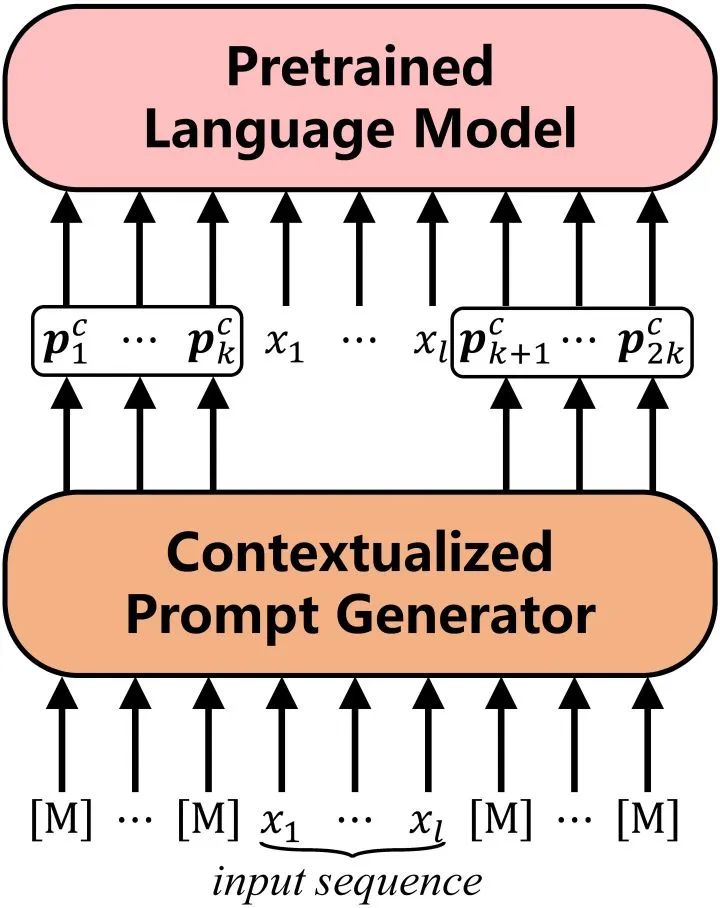

1.語境提示(contextualized prompts)

語境提示是基于輸入文本生成的提示,我們使用BERT作為提示生成器來抽取模型中有關輸入的知識,以此達到豐富信息量的目的。  ? 具體的,我們在??兩端各放置??個??得到BERT的輸入: ?? 經過BERT的編碼,我們得到這些??的頂層表示,作為初始提示: ?? 然后我們使用一種“語義對齊”操作,將這些隱提示對應到真實詞表空間,得到我們的語境提示??: ?? 其中??是BERT的詞表矩陣,??是BERT預測??的映射矩陣。直覺地,我們可以將語義對齊操作看做是預測??的概率分布,然后將相應的詞向量加權平均。 ? 最后我們將語境提示加在輸入兩端,使用BART作為我們的生成模型,建模輸入??到輸出??的概率: ?? 2.連續反向提示(continuous inverse prompting) 連續反向提示通過建模從輸出到輸入的反向過程,改進自然語言生成,使生成文本與輸入的相關性更強。

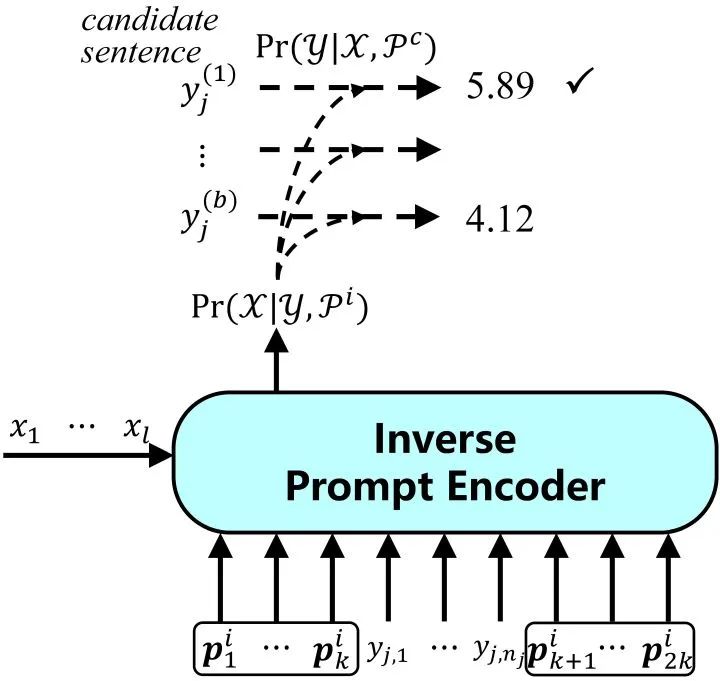

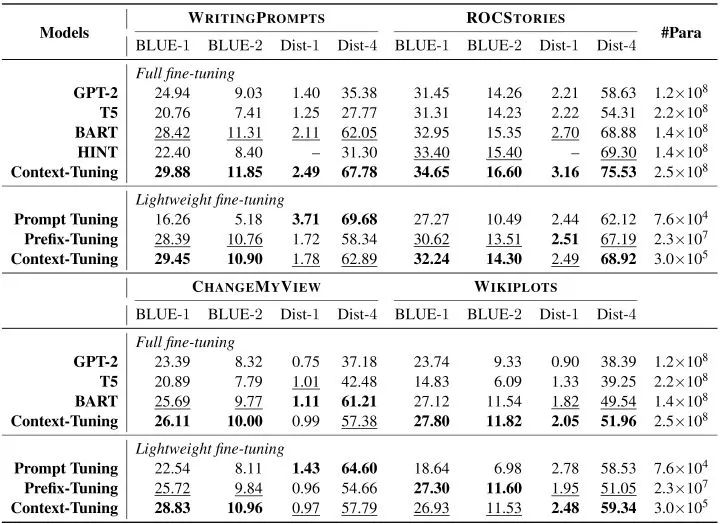

? 具體的,我們在??兩端各放置??個??得到BERT的輸入: ?? 經過BERT的編碼,我們得到這些??的頂層表示,作為初始提示: ?? 然后我們使用一種“語義對齊”操作,將這些隱提示對應到真實詞表空間,得到我們的語境提示??: ?? 其中??是BERT的詞表矩陣,??是BERT預測??的映射矩陣。直覺地,我們可以將語義對齊操作看做是預測??的概率分布,然后將相應的詞向量加權平均。 ? 最后我們將語境提示加在輸入兩端,使用BART作為我們的生成模型,建模輸入??到輸出??的概率: ?? 2.連續反向提示(continuous inverse prompting) 連續反向提示通過建模從輸出到輸入的反向過程,改進自然語言生成,使生成文本與輸入的相關性更強。  ? 我們有這樣一個假設,如果我們可以從輸出恢復輸入,我們便認為輸出與輸入相關。但在一些生成場景下,這從輸出恢復輸入并不自然,因此我們使用連續反向提示來緩解這一現象。我們在輸出兩端添加連續反向提示??,并建模輸出到輸入的概率: ?? 我們期望反向提示可以更好地反映輸出到輸入的關系,這更多取決于任務本身,因此這里的反向提示是靜態的。 ? 最后,我們結合語境提示和連續反向提示,選擇聯合概率最大的生成文本: ?? 3.輕量化語境調優 考慮到我們的語境提示引入了兩個預訓練模型,我們使用了一種輕量化微調方法BifFit,即僅微調每個參數的bias項,最終我們僅需要微調全量模型0.12%的參數。因此,我們在實驗中考慮了全量微調和輕量化微調兩種場景。 三、實驗 為了驗證語境調優的有效性,我們在四個開放式文本數據集上進行了測試:WritingPrompts,ROCStories,ChangeMyReivew和WikiPlots。 我們考慮了六個基線方法(其中前四個用于全量微調,后兩個用于輕量化微調):

? 我們有這樣一個假設,如果我們可以從輸出恢復輸入,我們便認為輸出與輸入相關。但在一些生成場景下,這從輸出恢復輸入并不自然,因此我們使用連續反向提示來緩解這一現象。我們在輸出兩端添加連續反向提示??,并建模輸出到輸入的概率: ?? 我們期望反向提示可以更好地反映輸出到輸入的關系,這更多取決于任務本身,因此這里的反向提示是靜態的。 ? 最后,我們結合語境提示和連續反向提示,選擇聯合概率最大的生成文本: ?? 3.輕量化語境調優 考慮到我們的語境提示引入了兩個預訓練模型,我們使用了一種輕量化微調方法BifFit,即僅微調每個參數的bias項,最終我們僅需要微調全量模型0.12%的參數。因此,我們在實驗中考慮了全量微調和輕量化微調兩種場景。 三、實驗 為了驗證語境調優的有效性,我們在四個開放式文本數據集上進行了測試:WritingPrompts,ROCStories,ChangeMyReivew和WikiPlots。 我們考慮了六個基線方法(其中前四個用于全量微調,后兩個用于輕量化微調):

通用文本生成模型:BART,GPT-2和T5;

專為故事生成設計的方法:HINT;

輕量化方法:Prefix-tuning和Prompt tuning

同時,我們使用BLEU來衡量生成文本的質量,用Distinct來評價生成文本的多樣性。  ? 實驗結果表明我們在全量微調和輕量化微調兩種場景下均優于基線模型,其中輕量化模型在僅微調0.12%參數的情況下可以達到全量微調98%的表現。

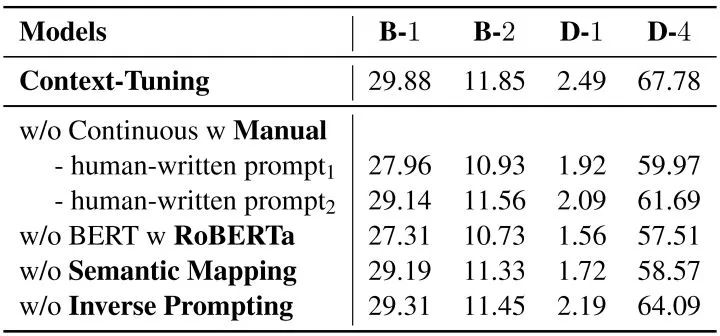

? 實驗結果表明我們在全量微調和輕量化微調兩種場景下均優于基線模型,其中輕量化模型在僅微調0.12%參數的情況下可以達到全量微調98%的表現。  ? 消融實驗中,我們嘗試替換語境提示、刪除語義對齊或反向提示,生成結果均有下降,這驗證了我們語境提示和連續反向提示的有效性。 ?

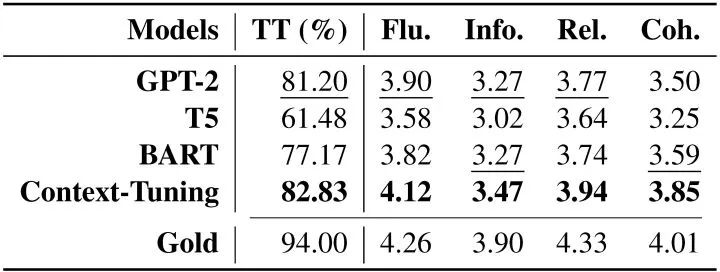

? 消融實驗中,我們嘗試替換語境提示、刪除語義對齊或反向提示,生成結果均有下降,這驗證了我們語境提示和連續反向提示的有效性。 ?  ? 人工評價表明,使用語境調優生成的文本在流暢性、信息量、相關性和一致性上均優于基線模型,且有82.83%的生成文本被認為是人所寫的。 ?

? 人工評價表明,使用語境調優生成的文本在流暢性、信息量、相關性和一致性上均優于基線模型,且有82.83%的生成文本被認為是人所寫的。 ?  ? 四、總結

? 四、總結  ? 本文提出了用于自然語言生成的“語境調優”技術: ?

? 本文提出了用于自然語言生成的“語境調優”技術: ?

我們提出“語境提示”,增強生成文本的信息量;

我們使用“連續反向提示”,增強生成文本的相關性;

我們提出輕量化微調語境調優,僅微調0.12%的參數卻能保持98%的性能。

-

數據

+關注

關注

8文章

7139瀏覽量

89573 -

模型

+關注

關注

1文章

3305瀏覽量

49217 -

深度學習

+關注

關注

73文章

5513瀏覽量

121544 -

自然語言

+關注

關注

1文章

291瀏覽量

13398

原文標題:COLING'22 | 如何增強文本生成的信息量和相關性?基于語境提示的生成方法Context-Tuning

文章出處:【微信號:zenRRan,微信公眾號:深度學習自然語言處理】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

基于用于自然語言生成的“語境調優”技術

基于用于自然語言生成的“語境調優”技術

評論