電子發燒友網報道(文/吳子鵬)在交出一份相當不理想的Q1財報之后,三星電子終于決定,將削減存儲芯片的產量,減產有望緩解供應過剩,提振陷入寒冬的半導體行業。

對于DRAM行業而言,這真的是巨大的利好,預計Q2將成為最后的調整期,然后產業走勢開始上揚。元大證券分析師Gilhyun Baik表示,DRAM的價格在本季度預計將下降約10%,而過去兩個季度的降幅分別為30%和20%,降價走勢明顯在收窄。

此前,我們在三星電子財報分析的文章中已經解讀過三星電子對DRAM市場的影響力,這里不再展開。不過,就在市場回暖的過程中,DRAM大廠美光科技又拋出了一個重磅消息,DRAM在AI大模型風靡的當下,或將成為繼GPU之外,另一個算力核心。

ChatGPT帶火新存儲技術CXL

實際上,不僅是美光科技發出過此番言論。華西證券近日在研報中也指出,在AI的大時代下,DRAM有望成為繼GPU后,另外一重要算力核心,同時DRAM的價值當前也被嚴重低估。

華西證券在研報中特別提到了CXL(Compute Express Link,計算快速鏈接)這項新技術,認為隨著CXL的應用滲透率提升,服務器也從傳統圍繞CPU的設計思路轉向為以DRAM為中心的架構。AI將成為DRAM下一增長周期中最重要的增長引擎。

CXL是Compute Express Link Consortium聯盟推出的一種新協議,是 PCI-e協議的升級技術,主要解決處理器、加速器和內存之間的cache一致性問題。

CXL技術的推出有望克服兩大難題:內存墻和I/O墻。其中,內存墻是指內存性能嚴重限制CPU性能發揮的現象;I/O墻和內存墻類似,是指I/O性能嚴重限制CPU性能發揮的現象。

這兩個墻問題的出現是因為,過去計算架構是以CPU為核心的,因此為了盡可能發揮CPU的性能,配置了多級存儲,并且是計算和存儲分離的,這就造成了內存墻,I/O墻則是因為數據傳輸的任務越來越多。

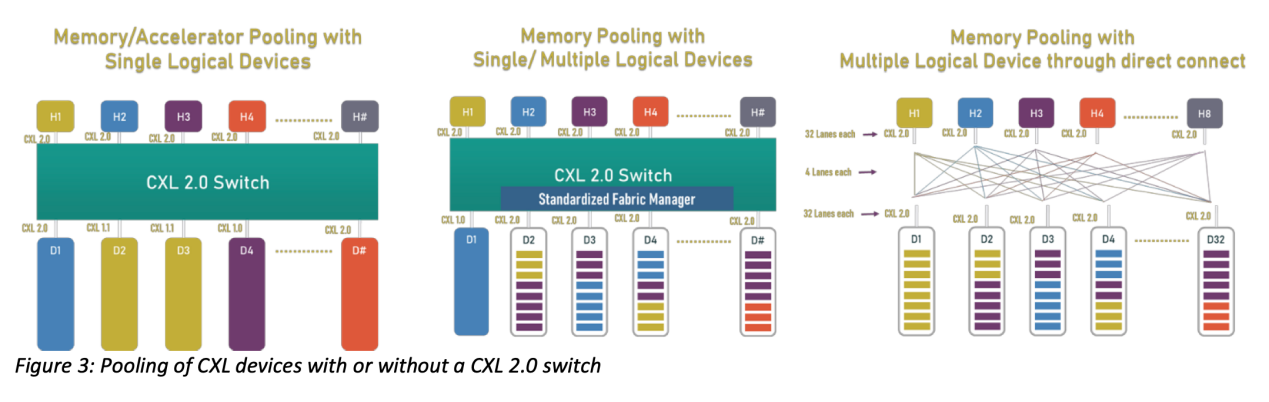

于是,產業界開始思考如何從數據存儲端去解決問題。因此,我們看到,在CXL2.0標準中就開始推動內存的池化。通過下圖能夠看到,內存池化的好處是非常明顯的,它讓內存不再專屬于某一個CPU,上面的CPU和下面的內存可以靈活地互聯互通,因此大大提升了內存的使用效率。

圖源:CXL聯盟官網

2022年8月,CXL 3.0標準發布。CXL 3.0 側重于在互連的幾個關鍵領域實現重大改進。第一個是物理方面,CXL 3.0將其每通道吞吐量翻了一番,達到64 GT/秒;在邏輯方面,CXL 3.0大大擴展了標準的邏輯能力,允許復雜的連接拓撲和結構,以及在一組CXL設備內更靈活的內存共享和內存訪問模式。

CXL 3.0標準進一步強化內存池化的概念,能夠從硬件層面實現內存共享。CXL標準的快速發展也得到了行業的廣泛關注,CXL聯盟也隨之成立,由英特爾牽頭,聯合阿里巴巴、戴爾EMC、Meta、谷歌、HPE、華為和微軟共同建立,隨后AMD、Arm加入其中。

并且,CXL標準不僅緩解了當前內存傳輸的帶寬限制,也使得方案轉變的重點從CPU轉移到了內存產品,因此CXL存儲器擴充成為主要的演進路線,而與之關系最密切的就是DRAM。

支持CXL標準的內存也被成為CXL內存,除了傳輸速度大幅提升,CXL內存另一個顯著變化是內存容量的巨大變化,三星、SK海力士研發的CXL內存已經可以做到單條96GB甚至128GB,因此實現TB級別的內存已經不是什么難事。

在ChatGPT領域,CXL內存的主要應用場景目前還集中在具有高性能GDDR或HBM本地內存的通用加速器,也就是給GPU帶來更好地內存支持。隨著大模型數量和體量的提升,對于CXL內存的需求量也會快速提升,因此將其稱為繼GPU之后的另一大算力芯片也不為過。

在泛AI領域,CXL內存還可用作沒有本地內存的專用加速器但可以利用CXL.io協議和 CXL.cache與主機處理器的內存;以及用于內存擴展板和存儲級內存。

HBM大單、急單增加

正如上文中提到的,對于ChatGPT類型的AI大模型,主要需求集中在GDDR或HBM等高性能內存產品上,其中HBM的需求增加非常明顯。當然,目前這部分產品主要還是遵循JEDEC組織頒布的標準,已經ready的最新標準是HBM3。

根據韓國媒體報道,近一段時間韓國內存大廠三星和SK海力士都接到了很多HBM內存的大單和急單。報道指出,全球最大的GPU公司英偉達一直在要求SK海力士提供最新的HBM3內存顆粒。供應鏈人士指出,最高性能的DRAM相比,HBM3目前的價格已經達到其5倍。

美光科技在2023財年第二財季業績會紀要中指出,“如今,AI 服務器的DRAM需求量可以達到普通服務器的8倍,NAND需求量則是3倍。我們的產品路線圖包括HBM3和CXL創新,期待可以在未來分享有關這些解決方案的更多細節。”“AI 的最新發展為大型語言模型或 LLM(例如 ChatGPT)的轉換功能奠定了基石。”

美光科技的發言揭露的兩大技術趨勢:其一是未來的HBM一定是和CXL深度融合,進一步提升HBM內存在容量和帶寬方面的性能;其二是AI也將推動內存的技術變革,HBM-PIM內存計算技術有望成為AI大模型領域的新寵。

當前,對于AI大模型這波機遇,國內的內存產業有怎樣的機會呢?從公開消息來看,目前國內還沒有規模量產HBM內存的企業。江波龍董秘此前在投資平臺表示,HBM技術屬于內存芯片設計技術與內存模組應用的結合。公司目前暫未涉及相關的內存芯片設計研發,但公司將保持對該技術的持續關注,并在產品應用層面上提前開展相關的研發布局工作。

不過,國內已經有公司在涉獵CXL內存領域。前不久,瀾起科技已經宣布,其PCIe 5.0/CXL 2.0 Retimer芯片成功實現量產。

小結

ChatGPT以及國內AI大模型密集的發布給DRAM產業帶來了新的發展機遇。由于應用的特殊性,AI大模型對HBM這種高級內存需求量更大,而國內在這方面還處于技術攻關的階段,沒有公開的實質性進展。不過,CXL技術的發展可能為國產DRAM企業帶來轉機,讓普通DRAM內存能夠參與到AI應用里。

從整體產業走勢來看,三星減產和AI大模型需求將分別從供給和需求端帶動DRAM產業,進入全新的旺周期。

-

DRAM

+關注

關注

40文章

2325瀏覽量

183868 -

GPT

+關注

關注

0文章

360瀏覽量

15505

發布評論請先 登錄

相關推薦

2025年Q1 DRAM內存市場步入淡季,價格預計下滑

2024年第三季度全球DRAM市場營收環比增長13.6%

2023年全球DRAM內存模組市場營收下滑,金士頓領跑

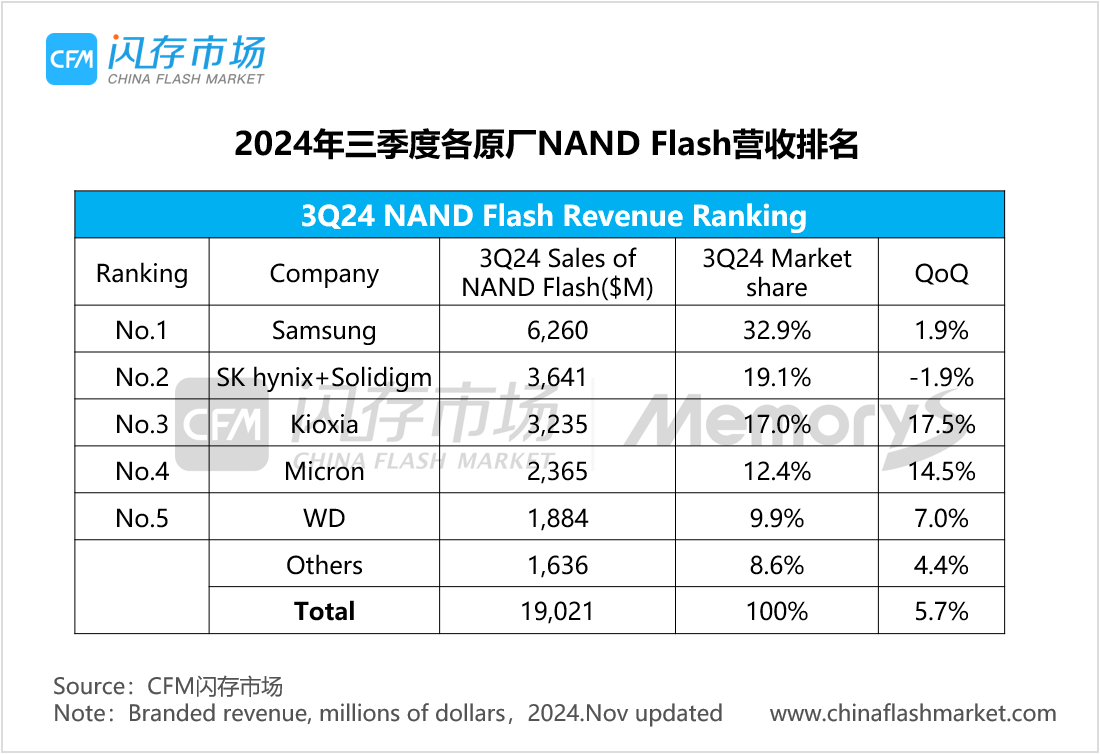

大漲96.8%,前三季度全球存儲市場規模突破1200億美元,3Q24 NAND Flash/DRAM市場營收排名出爐

預計第四季度DRAM市場僅HBM價格上漲

國產MCU有推薦嗎?最好是經過市場驗證的!

直播預告 | 探索干簧傳感技術在汽車市場的應用潛力

2024年DRAM收入將達到980億美元,同比增長88%

DRAM與NAND市場迎高增長,2024年收入飆升

OpenAI 推出 GPT-4o mini 取代GPT 3.5 性能超越GPT 4 而且更快 API KEY更便宜

SK海力士加大1b DRAM產能以滿足市場需求

三星/SK海力士DRAM大幅擴產,恢復至削減前水平,存儲新周期開啟

DRAM市場恢復元氣,還想在GPT市場干票大的?

DRAM市場恢復元氣,還想在GPT市場干票大的?

評論