現(xiàn)在,GPT-3.5 Turbo支持自定義微調(diào)了!

只需上傳自己的數(shù)據(jù),就可以運行專屬的定制大模型。

開發(fā)者狂喜!不少人驚呼:Awesome!

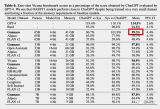

早期測試表明,經(jīng)過微調(diào)的GPT-3.5 Turbo版本在某些任務(wù)中甚至可以超越GPT-4。

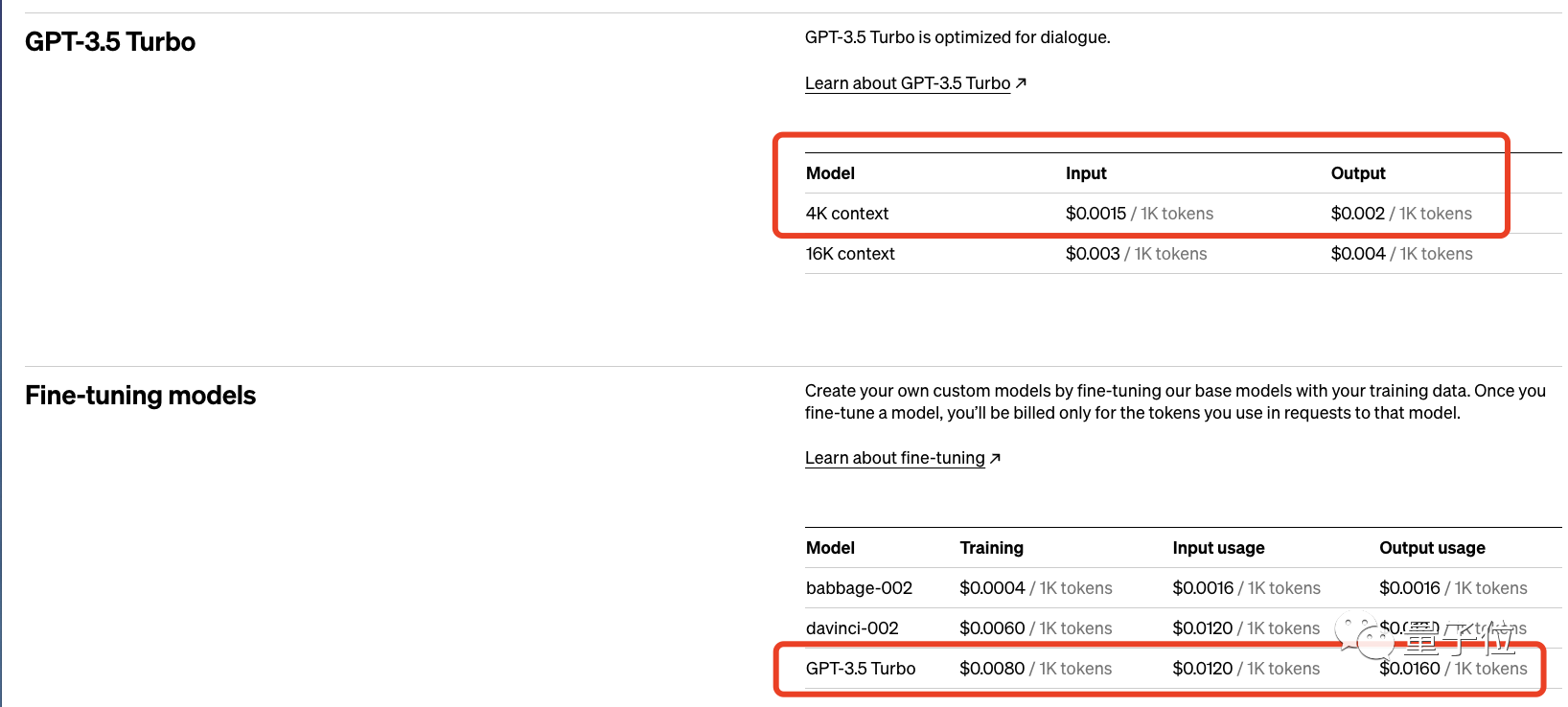

更新之余,OpenAI還直接明示了定價計劃,微調(diào)費用主要分為初始訓(xùn)練費用和使用費用。

一個具有10萬tokens訓(xùn)練數(shù)據(jù)集的微調(diào)工作(3個epoch訓(xùn)練)成本大概在2.40美元。

此外,OpenAI還透露了GPT-4微調(diào)將于今年秋天推出。

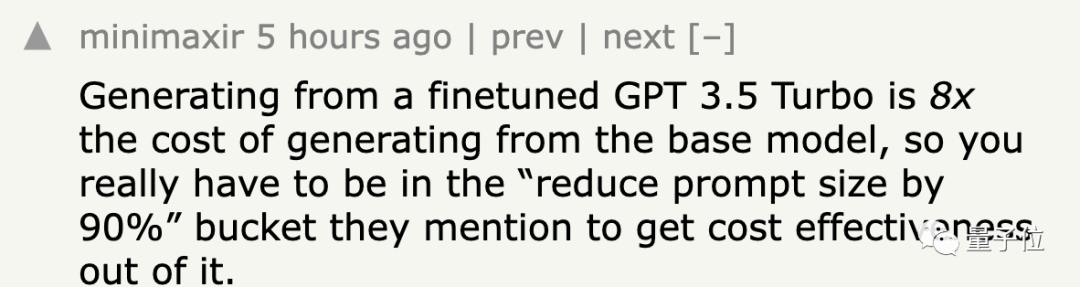

不過也有人不吃這套,吐槽微調(diào)成本太高,其生成成本是基礎(chǔ)模型的8倍,必須要按照他們所說“將提示大小減小90%”,才能從中獲取效益。

開發(fā)者自己進行監(jiān)督微調(diào)

OpenAI首先給出了指南手冊,微調(diào)可以用來改進這些模型性能。

-

可操縱性的改進,模型能夠更好地遵循指令。比如輸出簡潔回答或始終以給定的語言響應(yīng)。

-

一致的格式化響應(yīng),開發(fā)人員可用微調(diào)將用戶提示轉(zhuǎn)換為高質(zhì)量JSON代碼片段,隨后用于自己的系統(tǒng)。

-

定制語氣,微調(diào)可以更好磨煉模型輸出的質(zhì)感,比如語氣,讓它更適合企業(yè)品牌的聲音。

除了提高性能之外,還能縮短提示時間,確保類似性能。另外,微調(diào)目前僅支持處理4000 tokens,這也是此前微調(diào)型號的兩倍。16k tokens微調(diào)將于今年秋季推出。

早期測試人員通過對模型本身指令進行微調(diào),加快了API調(diào)用還降低成本,讓prompt減少了90%。

對函數(shù)調(diào)用結(jié)合和 gpt-3.5-turbo-16k的微調(diào)支持將在今年秋季晚些時候推出。

具體微調(diào)步驟,分為四步:

準(zhǔn)備數(shù)據(jù)

{

"messages":[

{"role":"system","content":"Youareanassistantthatoccasionallymisspellswords"},

{"role":"user","content":"Tellmeastory."},

{"role":"assistant","content":"Onedayastudentwenttoschoool."}

]

上傳文件

curl-https://api.openai.com/v1/files

-H"Authorization:Bearer$OPENAI_API_KEY"

-F"purpose=fine-tune"

-F"file=@path_to_your_file"

創(chuàng)建微調(diào)作業(yè)

curlhttps://api.openai.com/v1/fine_tuning/jobs

-H"Content-Type:application/json"

-H"Authorization:Bearer$OPENAI_API_KEY"

-d'{

"training_file":"TRAINING_FILE_ID",

"model":"gpt-3.5-turbo-0613",

}'

使用微調(diào)模型

curlhttps://api.openai.com/v1/chat/completions

-H"Content-Type:application/json"

-H"Authorization:Bearer$OPENAI_API_KEY"

-d'{

"model":"ftorg_id",

"messages":[

{

"role":"system",

"content":"Youareanassistantthatoccasionallymisspellswords"

},

{

"role":"user",

"content":"Hello!Whatisfine-tuning?"

}

]

}'

OpenAI透露,未來他們將推出微調(diào)UI,這樣輕松訪問正在進行中的工作。

定價方面,分為訓(xùn)練成本和使用成本。

-

訓(xùn)練:0.008美元/1000 tokens;

-

使用輸入:0.012美元/1000 tokens;

-

使用輸出:0.016 美元/1000 tokens。

不過可以看到的是,價格確實比基礎(chǔ)模型高了不少。

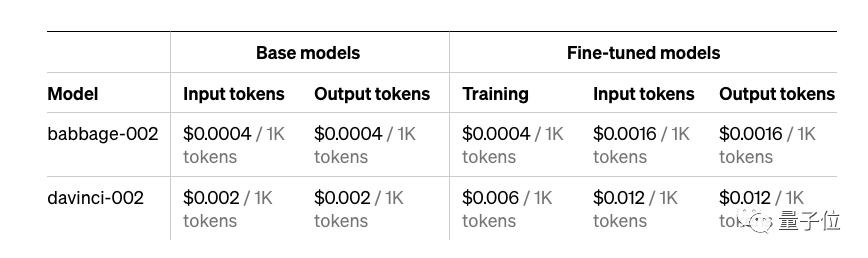

更新了GPT-3模型

與此同時,OpenAI還在API端口更新了GPT-3模型:babbage-002 和 davinci-002。

這些模型都可以用新的API端點進行微調(diào)。

原始基礎(chǔ)模型 (ada, babbage, curie, 和 davinci)將于明年*(2024年)1月4日關(guān)閉。

好了,感興趣的朋友可以開始定制自己的GPT-3.5Turbo了。

-

數(shù)據(jù)集

+關(guān)注

關(guān)注

4文章

1209瀏覽量

24834 -

OpenAI

+關(guān)注

關(guān)注

9文章

1139瀏覽量

6705 -

大模型

+關(guān)注

關(guān)注

2文章

2549瀏覽量

3169

原文標(biāo)題:OpenAI開放大模型微調(diào)功能!上傳自己數(shù)據(jù)就可定制GPT-3.5Turbo,開發(fā)者狂喜

文章出處:【微信號:玩轉(zhuǎn)VS Code,微信公眾號:玩轉(zhuǎn)VS Code】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

相關(guān)推薦

OpenAI 深夜拋出王炸 “ChatGPT- 4o”, “她” 來了

【「基于大模型的RAG應(yīng)用開發(fā)與優(yōu)化」閱讀體驗】+大模型微調(diào)技術(shù)解讀

怎么建立開放數(shù)控系統(tǒng)模型?

OpenAI官宣把ChatGPT API開放

iPhone都能微調(diào)大模型了嘛

最新、最強大的模型GPT-4將向美國政府機構(gòu)開放

OpenAI開放大模型微調(diào)功能 GPT-3.5可以打造專屬ChatGPT

四種微調(diào)大模型的方法介紹

OpenAI開放大模型微調(diào)功能!

OpenAI開放大模型微調(diào)功能!

評論