1. 寫在前面

圖像匹配是SLAM和圖像檢索的核心任務,但是傳統的圖像匹配很難處理遮擋問題。今天筆者將為大家分享一篇曠視的開源工作Occ2Net,使用3D Occupancy來解決遮擋問題下的圖像匹配。

下面一起來閱讀一下這項工作~

2. 摘要

圖像匹配是各種視覺應用中基本且關鍵的任務,如同時定位與地圖構建( Simultaneous Localization and Mapping,SLAM )和圖像檢索,這些應用都需要精確的位姿估計。然而,現有的大多數方法忽略了由相機運動和場景結構引起的物體之間的遮擋關系。在本文中,我們提出了一種新的圖像匹配方法Occ2Net,該方法使用3D占有率建模遮擋關系,并在遮擋區域中推斷匹配點。得益于占有率估計( Occupancy Estimation,OE )模塊中編碼的歸納偏差,它大大簡化了多視圖一致3D表示的引導,從而可以集成來自多個視圖的信息。它與一個遮擋感知( Occlusion-Aware,OA )模塊一起,結合了注意力層和旋轉對齊,以實現遮擋點和可見點之間的匹配。我們在真實世界和模擬數據集上評估了我們的方法,并在幾個指標上展示了其優于最先進方法的性能,特別是在遮擋場景中。

3. 效果展示

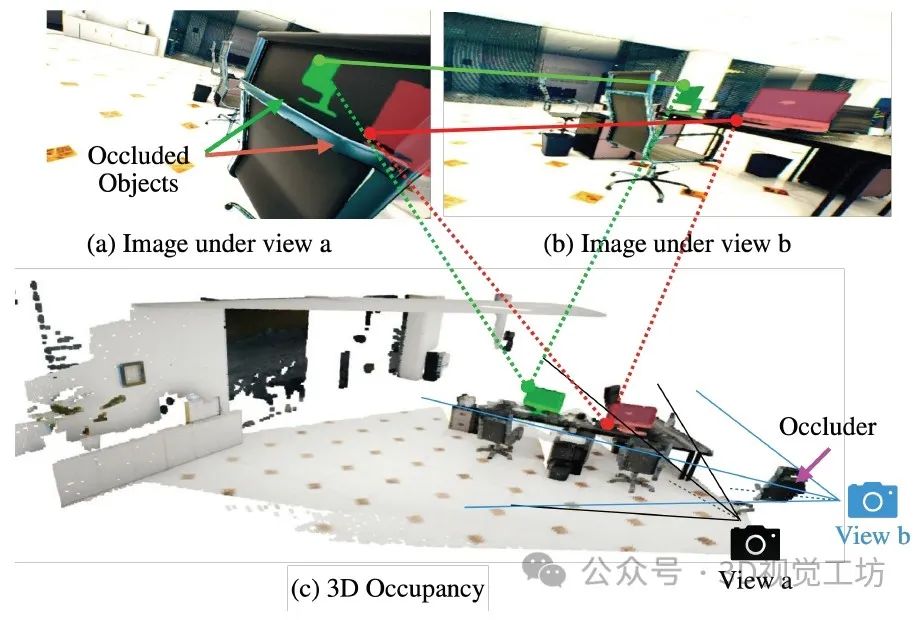

先看一下問題描述,( a )和( b )是從不同視點拍攝的圖像,而( c )顯示了遮擋區域的匹配過程。在( c )中,兩個顯示器顯示綠色和紅色的掩模,表示在( b )中可見但在( a )中被遮擋的區域。由于相機運動,兩個圖像的視差很大。雖然存在大量的重疊區域,但大的視差導致了遮擋,很大程度上減少了可見匹配對的數量。通過使用Occ2Net提取一致的占用特征并在( a )和( b )之間進行匹配,( a )中被遮擋的顯示器仍然可以在( b )中進行匹配,從而使Occ2Net具備了在遮擋情況下進行匹配的能力。

4. 具體原理是什么?

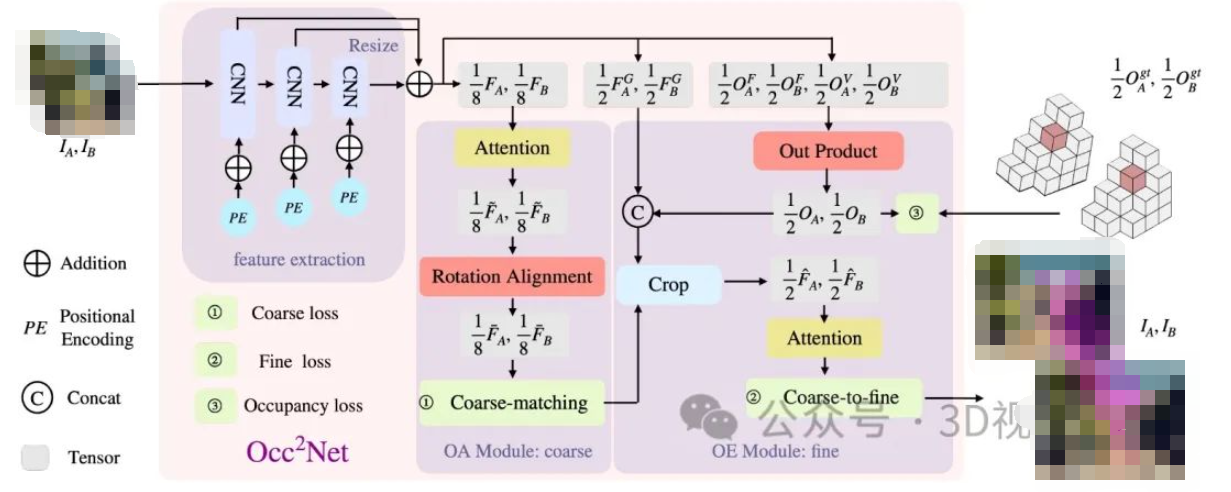

Occ2Net框架,通過隱式地模擬物體-遮擋關系,實現遮擋下的匹配。首先提取特征,然后應用OA模塊獲得粗匹配塊,最后將精細特征與OE模塊中的3D占用估計相結合進行精細匹配。

5. 和其他SOTA方法對比如何?

ScanNet、TartanAir-indoor、TartanAir-outdoor的匹配實例。綠色和黃色線條表示正確匹配,紅色線條(誤差大于10個像素)為錯誤匹配。

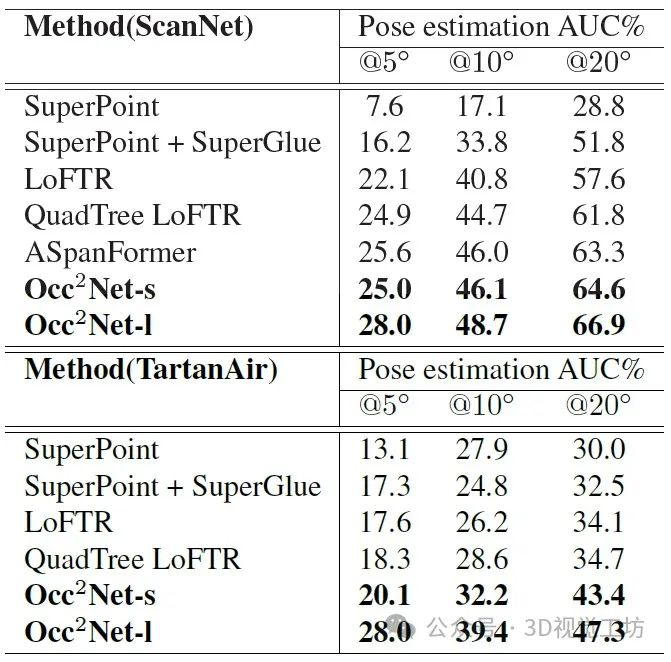

位姿誤差的百分比AUC對比,Occ2Net最優。

6. 總結

這篇文章提出了一種遮擋問題下的圖像匹配方式,設計了一種網絡結構Occ2Net,可以在一定程度上感知遮擋點的存在。Occ2Net使用特征提取來獲得多尺度的全局和位置特征,這些特征有助于猜測遮擋信息。OA模塊使用了注意力和旋轉對齊,這有助于在后期的由粗到精的過程中得到更多正確的匹配對。OE模塊使用3D占用估計結合精細特征進行精細匹配。

審核編輯:黃飛

-

SLAM

+關注

關注

23文章

426瀏覽量

31929 -

圖像匹配

+關注

關注

0文章

21瀏覽量

8834

原文標題:如何處理遮擋問題下的圖像匹配?

文章出處:【微信號:3D視覺工坊,微信公眾號:3D視覺工坊】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

基于Dragonboard 410c平臺的機器3D視覺—攝像機標定原理

基于ToF的3D活體檢測算法研究

浩辰3D的「3D打印」你會用嗎?3D打印教程

基于深度學習和3D圖像處理的精密加工件外觀缺陷檢測系統

平面人物秒變3D模式,圖片中的人物可以從平面中“跑出來”,動起來

iPhone 12沒有3D屏幕無法顯示3D圖像?

華為基于AI技術實現3D圖像數字服務

特斯拉的Occupancy Network占用網絡如何解決無法識別物體的難題呢?

如何用3D Occupancy處理遮擋問題下的圖像匹配?

如何用3D Occupancy處理遮擋問題下的圖像匹配?

評論