本文通俗簡單地介紹了什么是大模型、大模型是怎么訓(xùn)練出來的和大模型的作用。

什么是大模型

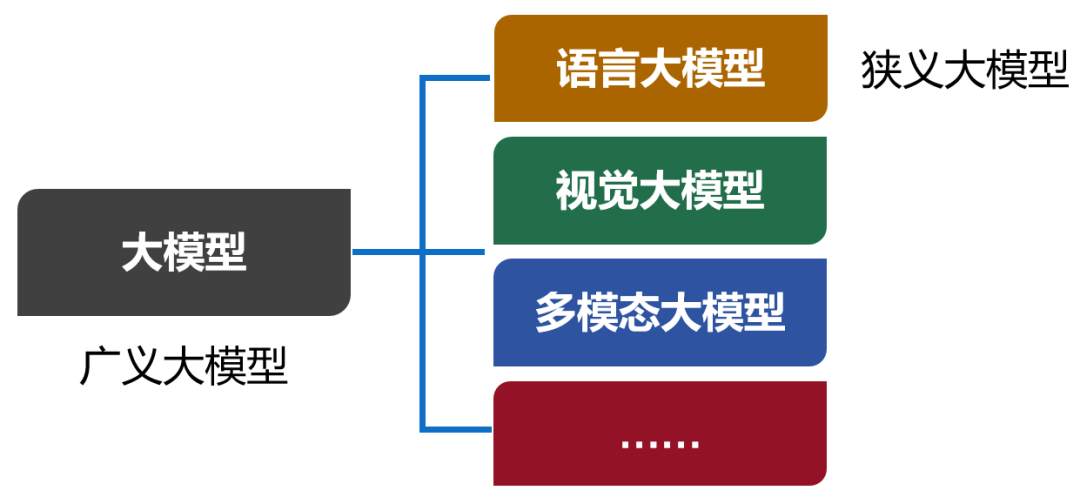

大模型,英文名叫Large Model,大型模型。早期的時候,也叫Foundation Model,基礎(chǔ)模型。 大模型是一個簡稱,完整的叫法,應(yīng)該是“人工智能預(yù)訓(xùn)練大模型”。預(yù)訓(xùn)練,是一項技術(shù),我們后面再解釋。 我們現(xiàn)在口頭上常說的大模型,實際上特指大模型的其中一類,也是用得最多的一類——語言大模型(Large Language Model,也叫大語言模型,簡稱LLM)。 除了語言大模型之外,還有視覺大模型、多模態(tài)大模型等。現(xiàn)在,包括所有類別在內(nèi)的大模型合集,被稱為廣義的大模型。而語言大模型,被稱為狹義的大模型。

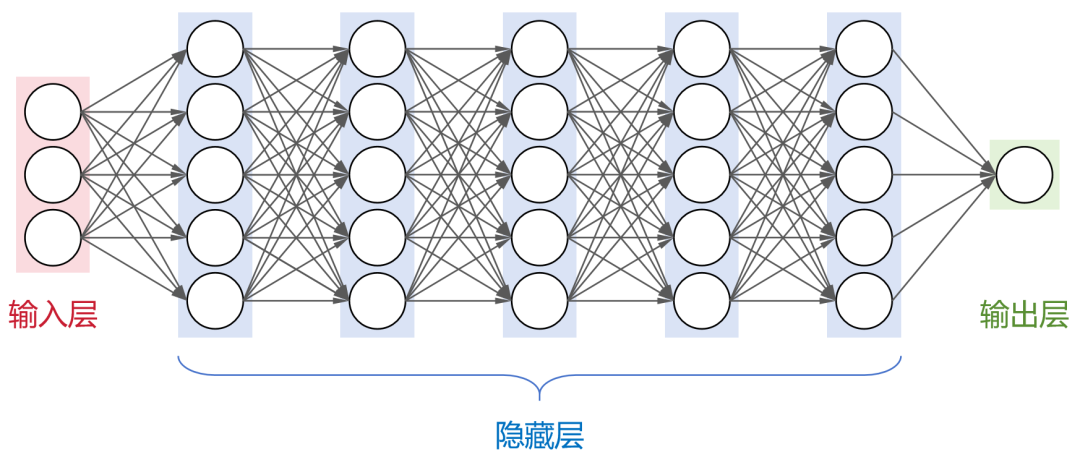

從本質(zhì)來說,大模型,是包含超大規(guī)模參數(shù)(通常在十億個以上)的神經(jīng)網(wǎng)絡(luò)模型。 神經(jīng)網(wǎng)絡(luò)是人工智能領(lǐng)域目前最基礎(chǔ)的計算模型。它通過模擬大腦中神經(jīng)元的連接方式,能夠從輸入數(shù)據(jù)中學(xué)習(xí)并生成有用的輸出。

這是一個全連接神經(jīng)網(wǎng)絡(luò)(每層神經(jīng)元與下一層的所有神經(jīng)元都有連接),包括1個輸入層,N個隱藏層,1個輸出層。 大名鼎鼎的卷積神經(jīng)網(wǎng)絡(luò)(CNN)、循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN)、長短時記憶網(wǎng)絡(luò)(LSTM)以及transformer架構(gòu),都屬于神經(jīng)網(wǎng)絡(luò)模型。 目前,業(yè)界大部分的大模型,都采用了transformer架構(gòu)。 剛才提到,大模型包含了超大規(guī)模參數(shù)。實際上,大模型的“大”,不僅是參數(shù)規(guī)模大,還包括:架構(gòu)規(guī)模大、訓(xùn)練數(shù)據(jù)大、算力需求大。

以GPT-3為例。這個大模型的隱藏層一共有96層,每層的神經(jīng)元數(shù)量達(dá)到2048個。 大模型的參數(shù)數(shù)量和神經(jīng)元節(jié)點(diǎn)數(shù)有一定的關(guān)系。簡單來說,神經(jīng)元節(jié)點(diǎn)數(shù)越多,參數(shù)也就越多。例如,GPT-3的參數(shù)數(shù)量,大約是1750億。 大模型的訓(xùn)練數(shù)據(jù),也是非常龐大的。 同樣以GPT-3為例,采用了45TB的文本數(shù)據(jù)進(jìn)行訓(xùn)練。即便是清洗之后,也有570GB。具體來說,包括CC數(shù)據(jù)集(4千億詞)+WebText2(190億詞)+BookCorpus(670億詞)+維基百科(30億詞),絕對堪稱海量。 最后是算力需求。 這個大家應(yīng)該都聽說過,訓(xùn)練大模型,需要大量的GPU算力資源。而且,每次訓(xùn)練,都需要很長的時間。

GPU算卡 根據(jù)公開的數(shù)據(jù)顯示,訓(xùn)練GPT-3大約需要3640PFLOP·天(PetaFLOP·Days)。如果采用512張A100 GPU(單卡算力195 TFLOPS),大約需要1個月的時間。訓(xùn)練過程中,有時候還會出現(xiàn)中斷,實際時間會更長。 總而言之,大模型就是一個虛擬的龐然大物,架構(gòu)復(fù)雜、參數(shù)龐大、依賴海量數(shù)據(jù),且非常燒錢。 相比之下,參數(shù)較少(百萬級以下)、層數(shù)較淺的模型,是小模型。小模型具有輕量級、高效率、易于部署等優(yōu)點(diǎn),適用于數(shù)據(jù)量較小、計算資源有限的垂直領(lǐng)域場景。

大模型是如何訓(xùn)練出來的?

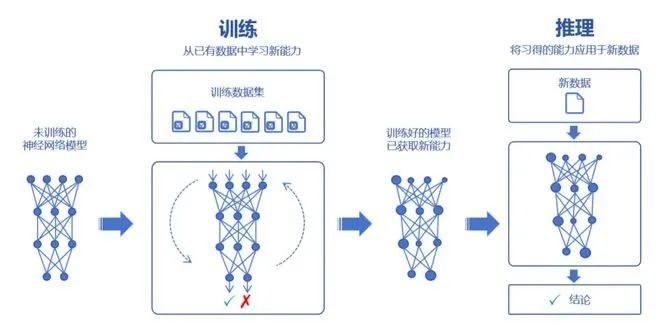

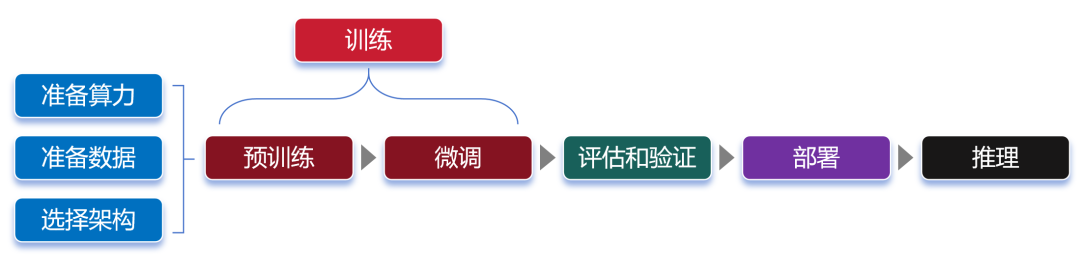

接下來,我們了解一下大模型的訓(xùn)練過程。 大家都知道,大模型可以通過對海量數(shù)據(jù)的學(xué)習(xí),吸收數(shù)據(jù)里面的“知識”。然后,再對知識進(jìn)行運(yùn)用,例如回答問題、創(chuàng)造內(nèi)容等。 學(xué)習(xí)的過程,我們稱之為訓(xùn)練。運(yùn)用的過程,則稱之為推理。

訓(xùn)練,又分為預(yù)訓(xùn)練(Pre-trained)和微調(diào)(Fine tuning)兩個環(huán)節(jié)。

預(yù)訓(xùn)練

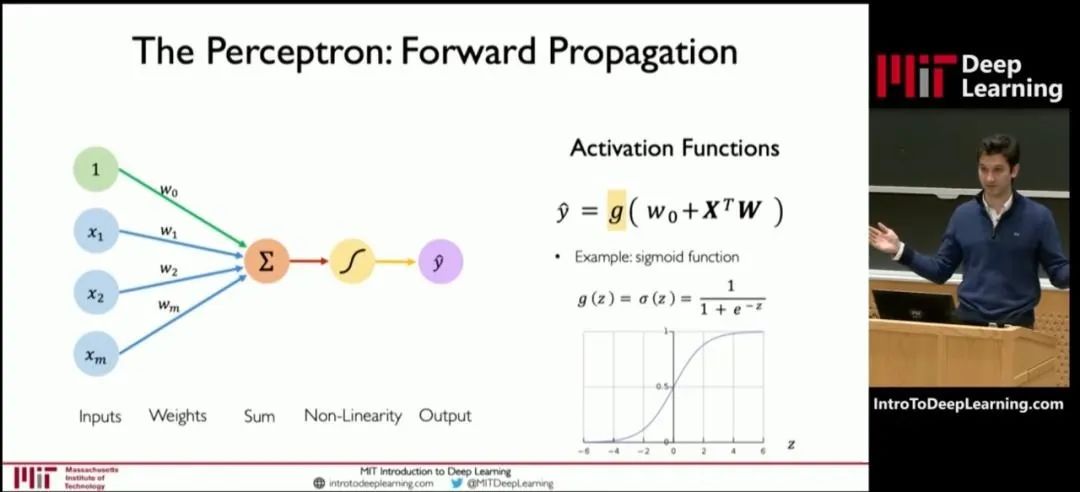

在預(yù)訓(xùn)練時,我們首先要選擇一個大模型框架,例如transformer。然后,通過“投喂”前面說的海量數(shù)據(jù),讓大模型學(xué)習(xí)到通用的特征表示。 那么,為什么大模型能夠具有這么強(qiáng)大的學(xué)習(xí)能力?為什么說它的參數(shù)越多,學(xué)習(xí)能力就越強(qiáng)? 我們可以參考MIT(麻省理工)公開課的一張圖:

這張圖是深度學(xué)習(xí)模型中一個神經(jīng)元的結(jié)構(gòu)圖。 神經(jīng)元的處理過程,其實就是一個函數(shù)計算過程。算式中,x是輸入,y是輸出。預(yù)訓(xùn)練,就是通過x和y,求解W。W是算式中的“權(quán)重(weights)”。 權(quán)重決定了輸入特征對模型輸出的影響程度。通過反復(fù)訓(xùn)練來獲得權(quán)重,這就是訓(xùn)練的意義。 權(quán)重是最主要的參數(shù)類別之一。除了權(quán)重之外,還有另一個重要的參數(shù)類別——偏置(biases)。

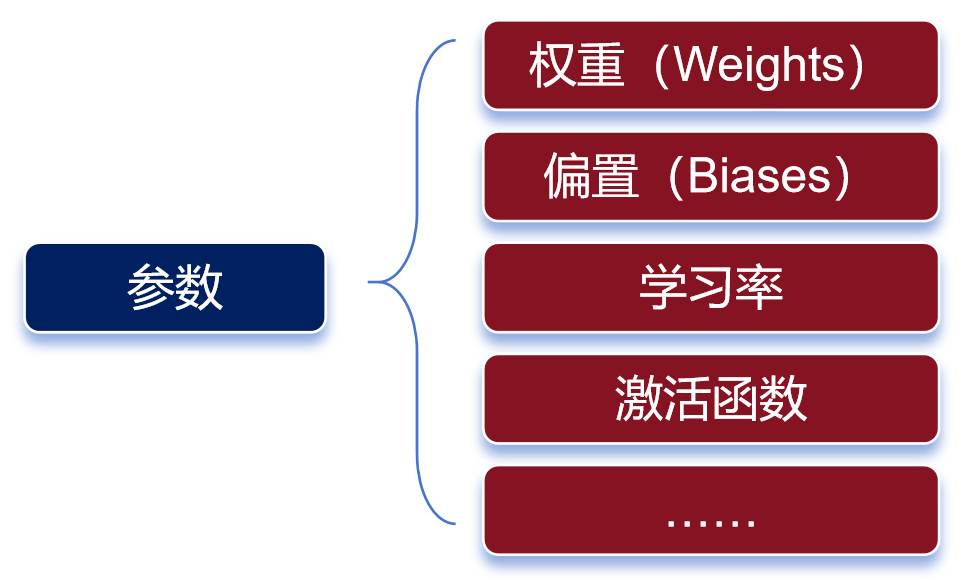

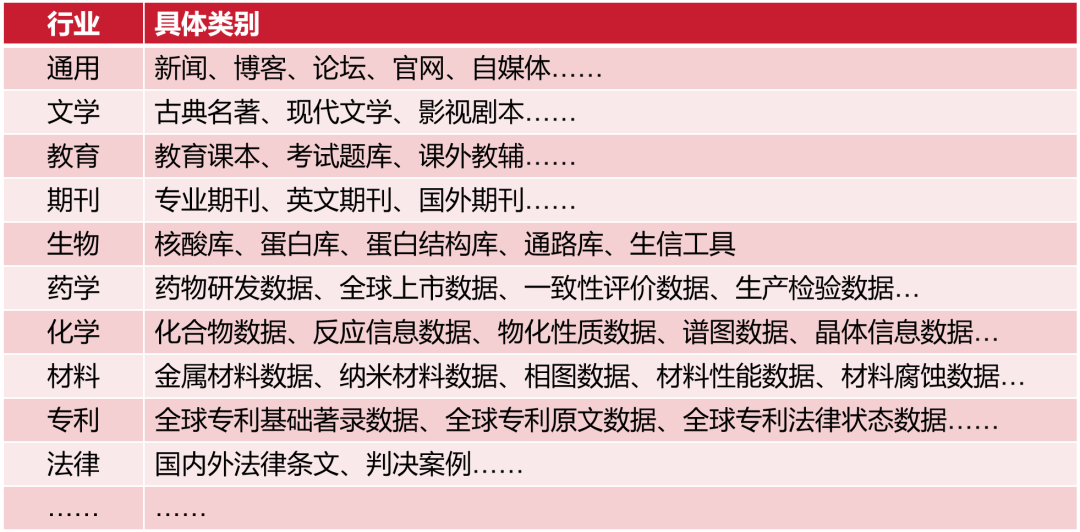

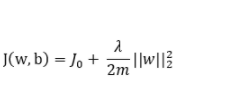

參數(shù)有很多種類 權(quán)重決定了輸入信號對神經(jīng)元的影響程度,而偏置則可以理解為神經(jīng)元的“容忍度”,即神經(jīng)元對輸入信號的敏感程度。 簡單來說,預(yù)訓(xùn)練的過程,就是通過對數(shù)據(jù)的輸入和輸出,去反復(fù)“推算”最合理的權(quán)重和偏置(也就是參數(shù))。訓(xùn)練完成后,這些參數(shù)會被保存,以便模型的后續(xù)使用或部署。 參數(shù)越多,模型通常能夠?qū)W習(xí)到更復(fù)雜的模式和特征,從而在各種任務(wù)上表現(xiàn)出更強(qiáng)的性能。 我們通常會說大模型具有兩個特征能力——涌現(xiàn)能力和泛化能力。 當(dāng)模型的訓(xùn)練數(shù)據(jù)和參數(shù)不斷擴(kuò)大,直到達(dá)到一定的臨界規(guī)模后,會表現(xiàn)出一些未能預(yù)測的、更復(fù)雜的能力和特性。模型能夠從原始訓(xùn)練數(shù)據(jù)中,自動學(xué)習(xí)并發(fā)現(xiàn)新的、更高層次的特征和模式。這種能力,被稱為“涌現(xiàn)能力”。 “涌現(xiàn)能力”,可以理解為大模型的腦子突然“開竅”了,不再僅僅是復(fù)述知識,而是能夠理解知識,并且能夠發(fā)散思維。 泛化能力,是指大模型通過“投喂”海量數(shù)據(jù),可以學(xué)習(xí)復(fù)雜的模式和特征,可以對未見過的數(shù)據(jù)做出準(zhǔn)確的預(yù)測。 參數(shù)規(guī)模越來越大,雖然能讓大模型變得更強(qiáng),但是也會帶來更龐大的資源消耗,甚至可能增加“過擬合”的風(fēng)險。 過擬合,是指模型對訓(xùn)練數(shù)據(jù)學(xué)習(xí)得過于精確,以至于它開始捕捉并反映訓(xùn)練數(shù)據(jù)中的噪聲和細(xì)節(jié),而不是數(shù)據(jù)的總體趨勢或規(guī)律。說白了,就是大模型變成了“書呆子”,只會死記硬背,不愿意融會貫通。 預(yù)訓(xùn)練所使用的數(shù)據(jù),我們也需要再說明一下。 預(yù)訓(xùn)練使用的數(shù)據(jù),是海量的未標(biāo)注數(shù)據(jù)(幾十TB)。 之所以使用未標(biāo)注數(shù)據(jù),是因為互聯(lián)網(wǎng)上存在大量的此類數(shù)據(jù),很容易獲取。而標(biāo)注數(shù)據(jù)(基本上靠人肉標(biāo)注)需要消耗大量的時間和金錢,成本太高。 預(yù)訓(xùn)練模型,可以通過無監(jiān)督學(xué)習(xí)方法(如自編碼器、生成對抗網(wǎng)絡(luò)、掩碼語言建模、對比學(xué)習(xí)等,大家可以另行了解),從未標(biāo)注數(shù)據(jù)中,學(xué)習(xí)到數(shù)據(jù)的通用特征和表示。 這些數(shù)據(jù),也不是隨便網(wǎng)上下載得來的。整個數(shù)據(jù)需要經(jīng)過收集、清洗、脫敏和分類等過程。這樣可以去除異常數(shù)據(jù)和錯誤數(shù)據(jù),還能刪除隱私數(shù)據(jù),讓數(shù)據(jù)更加標(biāo)準(zhǔn)化,有利于后面的訓(xùn)練過程。 獲取數(shù)據(jù)的方式,也是多樣化的。 如果是個人和學(xué)術(shù)研究,可以通過一些官方論壇、開源數(shù)據(jù)庫或者研究機(jī)構(gòu)獲取。如果是企業(yè),既可以自行收集和處理,也可以直接通過外部渠道(市場上有專門的數(shù)據(jù)提供商)購買。

微調(diào)

預(yù)訓(xùn)練學(xué)習(xí)之后,我們就得到了一個通用大模型。這種模型一般不能直接拿來用,因為它在完成特定任務(wù)時往往表現(xiàn)不佳。 這時,我們需要對模型進(jìn)行微調(diào)。 微調(diào),是給大模型提供特定領(lǐng)域的標(biāo)注數(shù)據(jù)集,對預(yù)訓(xùn)練的模型參數(shù)進(jìn)行微小的調(diào)整,讓模型更好地完成特定任務(wù)。

行業(yè)數(shù)據(jù)類別 微調(diào)之后的大模型,可以稱之為行業(yè)大模型。例如,通過基于金融證券數(shù)據(jù)集的微調(diào),可以得到一個金融證券大模型。 如果再基于更細(xì)分的專業(yè)領(lǐng)域進(jìn)行微調(diào),就是專業(yè)大模型(也叫垂直大模型)。 我們可以把通用大模型理解為中小學(xué)生,行業(yè)大模型是大學(xué)本科生,專業(yè)大模型是研究生。

微調(diào)階段,由于數(shù)據(jù)量遠(yuǎn)小于預(yù)訓(xùn)練階段,所以對算力需求小很多。 大家注意,對于大部分大模型廠商來說,他們一般只做預(yù)訓(xùn)練,不做微調(diào)。而對于行業(yè)客戶來說,他們一般只做微調(diào),不做預(yù)訓(xùn)練。 “預(yù)訓(xùn)練+微調(diào)”這種分階段的大模型訓(xùn)練方式,可以避免重復(fù)的投入,節(jié)省大量的計算資源,顯著提升大模型的訓(xùn)練效率和效果。 預(yù)訓(xùn)練和微調(diào)都完成之后,需要對這個大模型進(jìn)行評估。通過采用實際數(shù)據(jù)或模擬場景對大模型進(jìn)行評估驗證,確認(rèn)大模型的性能、穩(wěn)定性和準(zhǔn)確性?等是否符合設(shè)計要求。 等評估和驗證也完成,大模型基本上算是打造成功了。接下來,我們可以部署這個大模型,將它用于推理任務(wù)。 換句話說,這時候的大模型已經(jīng)“定型”,參數(shù)不再變化,可以真正開始干活了。 大模型的推理過程,就是我們使用它的過程。通過提問、提供提示詞(Prompt),可以讓大模型回答我們的問題,或者按要求進(jìn)行內(nèi)容生成。 最后,畫一張完整的流程圖:

大模型究竟有什么作用?

根據(jù)訓(xùn)練的數(shù)據(jù)類型和應(yīng)用方向,我們通常會將大模型分為語言大模型(以文本數(shù)據(jù)進(jìn)行訓(xùn)練)、音頻大模型(以音頻數(shù)據(jù)進(jìn)行訓(xùn)練)、視覺大模型(以圖像數(shù)據(jù)進(jìn)行訓(xùn)練),以及多模態(tài)大模型(文本和圖像都有)。 語言大模型,擅長自然語言處理(NLP)領(lǐng)域,能夠理解、生成和處理人類語言,常用于文本內(nèi)容創(chuàng)作(生成文章、詩歌、代碼)、文獻(xiàn)分析、摘要匯總、機(jī)器翻譯等場景。大家熟悉的ChatGPT,就屬于此類模型。 音頻大模型,可以識別和生產(chǎn)語音內(nèi)容,常用于語音助手、語音客服、智能家居語音控制等場景。 視覺大模型,擅長計算機(jī)視覺(CV)領(lǐng)域,可以識別、生成甚至修復(fù)圖像,常用于安防監(jiān)控、自動駕駛、醫(yī)學(xué)以及天文圖像分析等場景。 多模態(tài)大模型,結(jié)合了NLP和CV的能力,通過整合并處理來自不同模態(tài)的信息(文本、圖像、音頻和視頻等),可以處理跨領(lǐng)域的任務(wù),例如文生圖,文生視頻、跨媒體搜索(通過上傳圖,搜索和圖有關(guān)的文字描述)等。 今年以來,多模態(tài)大模型的崛起勢頭非常明顯,已經(jīng)成為行業(yè)關(guān)注的焦點(diǎn)。 如果按照應(yīng)用場景進(jìn)行分類,那么類別就更多了,例如金融大模型、醫(yī)療大模型、法律大模型、教育大模型、代碼大模型、能源大模型、政務(wù)大模型、通信大模型,等等。 例如金融大模型,可以用于風(fēng)險管理、信用評估、交易監(jiān)控、市場預(yù)測、合同審查、客戶服務(wù)等。功能和作用很多很多,不再贅述。

-

大模型

+關(guān)注

關(guān)注

2文章

2545瀏覽量

3161 -

LLM

+關(guān)注

關(guān)注

0文章

299瀏覽量

398

原文標(biāo)題:寫給小白的大模型入門科普

文章出處:【微信號:bdtdsj,微信公眾號:中科院半導(dǎo)體所】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

相關(guān)推薦

深層神經(jīng)網(wǎng)絡(luò)模型的訓(xùn)練:過擬合優(yōu)化

【大語言模型:原理與工程實踐】大語言模型的基礎(chǔ)技術(shù)

【大語言模型:原理與工程實踐】大語言模型的預(yù)訓(xùn)練

Pytorch模型訓(xùn)練實用PDF教程【中文】

深度融合模型的特點(diǎn)

pytorch訓(xùn)練出來的模型參數(shù)保存為嵌入式C語言能夠調(diào)用形式的方法

在Ubuntu上使用Nvidia GPU訓(xùn)練模型

海思AI芯片學(xué)習(xí)(十)將yolov3 darknet模型轉(zhuǎn)換為caffemodel

CNN根本無需理解圖像全局結(jié)構(gòu),一樣也能SOTA?

AI模型如何將它導(dǎo)入工程里

什么是預(yù)訓(xùn)練AI模型?

深度學(xué)習(xí)如何訓(xùn)練出好的模型

關(guān)于人工智能的幾個相關(guān)概念

什么是大模型、大模型是怎么訓(xùn)練出來的及大模型作用

什么是大模型、大模型是怎么訓(xùn)練出來的及大模型作用

評論