一、Flexus 云服務器 X 實例概要

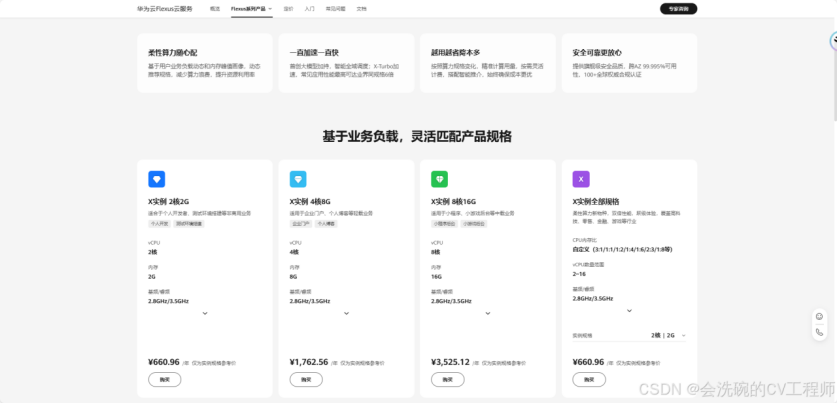

Flexus云服務器X實例是華為云推出的一款面向中小企業和開發者的柔性算力云服務器。這款服務器的主要特點是其靈活的 vCPU 內存配比,支持熱變配不中斷業務變更規格,以及能夠智能感知業務負載并自動調整資源配置,如下圖。

?1.1 Flexus 云服務器 X 實例摘要

Flexus 云服務器 X 實例的設計理念是提供一個更加靈活和高效的計算資源管理方式。其通過智能調整資源配置,能夠更好地滿足不同業務的需求,提高資源利用率。此外,該實例還提供了豐富的公共鏡像供用戶選擇,方便快速部署各種應用和服務。用戶還可以根據自己的需要靈活調整虛擬 CPU 和內存的配比,以滿足不同場景的需求。

1.2 產品特點

除了之前提到的靈活的 vCPU 內存配比、支持熱變配、智能感知業務負載以及出色的存儲性能外,Flexus 云服務器 X 實例的產品特點還包括以下幾個方面:

1.高性能與成本優化:

1.Flexus X 實例通過 X-Turbo 加速技術,實現了性能上的顯著提升,為用戶帶來了倍增的性能體驗。

2.該實例提供了經濟型的價格和近乎旗艦級的性能,實現了躍級體驗,同時降低了算力成本。

2.廣泛的應用場景:

1.Flexus X 實例覆蓋了高科技、零售、金融、游戲等多個行業的大多數通用工作負載場景,包括網絡應用、數據庫、虛擬桌面、分析索引、微服務、CI/CD 等。

2.它能夠滿足多樣化的業務需求,為中小企業和開發者提供即開即用、超快部署的云計算解決方案。

3.安全性與可靠性:

1.Flexus X 實例擁有華為云旗艦級云服務器產品相同的單 AZ 99.975%可用性,跨 AZ 99.995%可用性,確保了服務的高可靠性。

2.該實例還提供了智能識別和全面的安全防護技術,確保提供智能化且安全的云服務。

4.易用性與維護性:

1.Flexus X 實例內置了豐富的解決方案與鏡像,支持零門檻快速搭建業務環境,輕松啟動和管理業務。

2.用戶可以通過簡單的配置和購買流程,快速上手并使用該實例。

5.靈活的計費模式:

1.Flexus X 實例支持包年/包月和按需計費等多種計費模式,用戶可以根據自己的業務需求選擇合適的計費方式。

官網如下圖:

?1.3存儲方面性能

Flexus 云服務器 X 實例在存儲方面表現出色。它支持多種存儲類型,包括系統盤和數據盤,且系統盤為通用型 SSD,確保了數據讀寫的高速性和穩定性。用戶可以根據自己的業務需求選擇合適的存儲類型和容量。此外,該實例還支持快照和備份功能,確保數據的安全性和可恢復性。在數據處理和存儲方面,Flexus 云服務器 X 實例滿足了現代企業對高性能和高可靠性的要求。

Flexus 云服務器 X 實例以其靈活的資源配置、高效的計算性能和可靠的存儲能力,成為了中小企業和開發者的優選云服務器產品。

接下來,我們就利用 FIO 工具來測試一下 Flexus 云服務器 X 實例在存儲方面的性能怎么樣,主要從 IOPS,IO 延遲、IOPS 和吞吐量等方面進行測試。

1.4 測評服務器規格

二、FIO 工具

FIO(Flexible I/O Tester)是一款開源的磁盤 I/O 性能測試工具,旨在提供一種全方面的測試方案,能夠模擬常見的 I/O 場景,并記錄和評估存儲系統(如硬盤、固態硬盤、網絡存儲等)在不同負載條件下的輸入/輸出(I/O)性能。該工具廣泛應用于標準測試、QA(質量保證)、驗證測試等領域,并支持多種操作系統,如 Linux、FreeBSD、NetBSD、OS X、OpenSolaris、AIX、HP-UX、Windows 等。對于存儲性能的測試,首選就是 FIO。在本次測評中測試示例均使用 fio jobfile 方式,即通過一個 job 文件來描述待訪真的 IO 負載,一個 job 文件可以控制產生任意數目的線程和文件,典型的 job 文件包含一個 global 段(定義共享參數)和一個或多少 job 段(描述具體要產生的 job)。

2.1 安裝部署 FIO

其下載地址:https://brick.kernel.dk/snaps/fio-2.1.10.tar.gz

或者登錄其官網:http://freshmeat.sourceforge.net/projects/fio/進行下載。但是官網很難找得到入口在哪,還是直接訪問第一個鏈接就可以下載了。

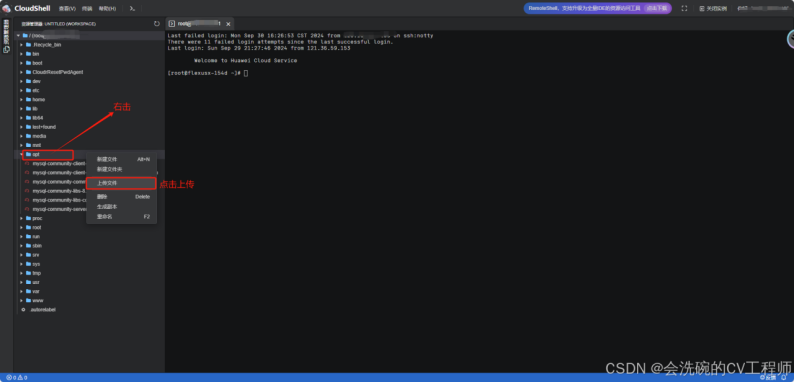

接下來我們上傳到服務器中,還是老規矩,我們使用 cloudshell 遠程登陸我們的服務器。接下來我們將剛剛下載的 FIO 壓縮包上傳到服務器的 opt 目錄下:如下圖所示:

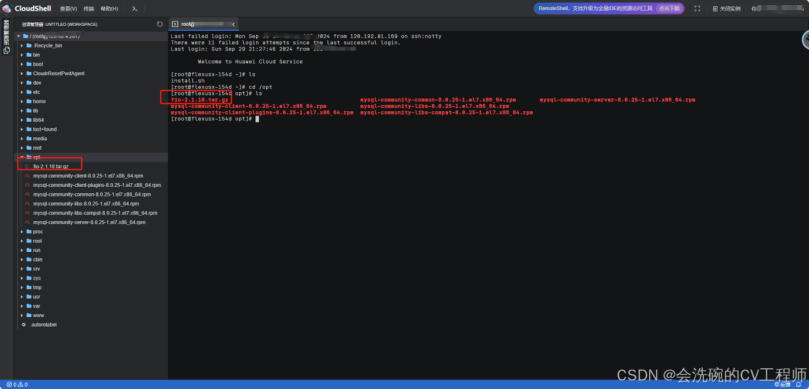

OK,我們輸入 ls 命令看看是否上傳成功。

?可以看得到,我們的安裝包已經上傳進去了,右側文件管理器也有該壓縮包。接下來我們解壓安裝:

執行以下命令解壓縮安裝包到我們的/usr/local 目錄下:

tar -zxvf fio-2.1.10.tar.gz -C /usr/local

注意:這里最好是先安裝好下面兩個依賴再執行,上面的安裝命令,這里我忘記了,因此還要重新編譯 fio

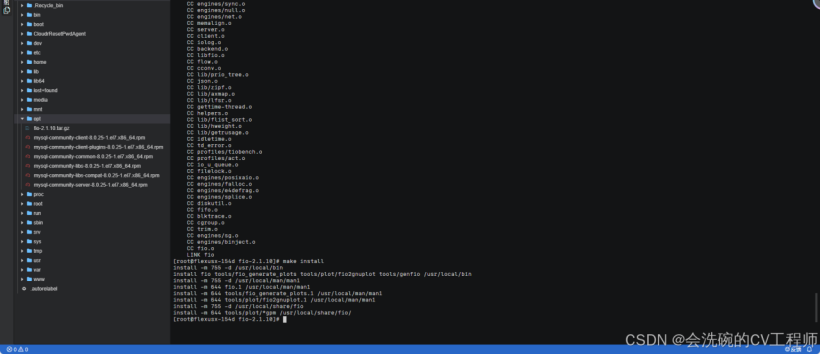

按順序執行以下命令進行安裝:

cd /usr/local/fio-2.1.10

./configure

make

make install

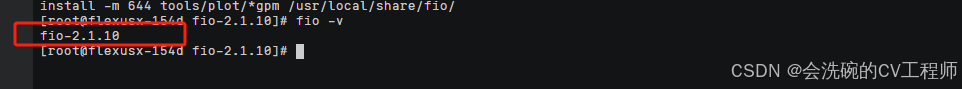

?OK,到這里我們就基本安裝完成了,然后使用 fio -v 命令查看一下版本看看是否安裝好:

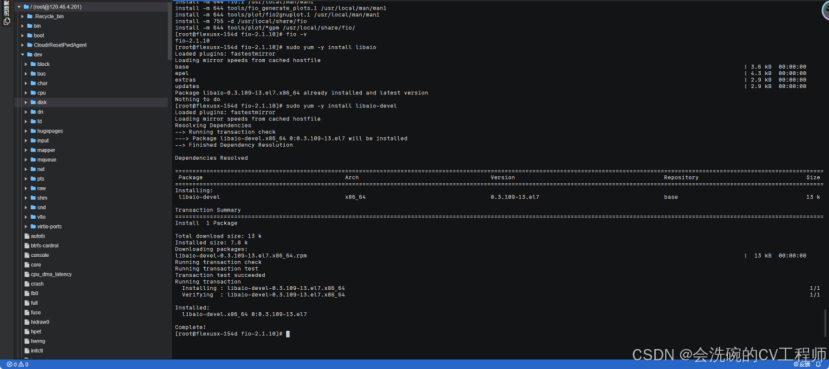

?因為 fio 還需要 libaio 依賴,然后依次執行以下命令,安裝 libaio:

sudo yum -y install libaio

sudo yum -y install libaio-devel

注意:這里最好是先安裝好上面兩個依賴再執行,上面的安裝命令,這里我忘記了,因此還要重新編譯 fio

?

可以看到我們已經安裝好了。

2.2 主要性能指標概要

下列這些都是服務器關于存儲性能的相關指標

1.IOPS(Input/Output Operations Per Second):

1.定義:每秒的輸入輸出操作次數,是衡量存儲設備性能的重要指標之一。

2.重要性:IOPS 越高,表示存儲設備在單位時間內能夠處理的 I/O 操作越多,性能越好。

2.吞吐量(Throughput):

1.定義:存儲設備在單位時間內傳輸的數據量。

2.重要性:吞吐量越大,表示存儲設備的數據傳輸速度越快,性能越好。

3.延遲(Latency):

1.定義:I/O 操作的響應時間,即從發出 I/O 請求到接收到響應的時間。

2.重要性:延遲越小,表示存儲設備的響應速度越快,用戶體驗越好。

4.CPU 利用率:

1.定義:在執行 I/O 操作時,CPU 的使用率。

2.重要性:CPU 利用率反映了 I/O 操作對系統資源的占用情況,過高的 CPU 利用率可能導致系統性能下降。

5.I/O 深度:

1.定義:并發發出的 I/O 請求數,也稱為隊列深度。

2.重要性:I/O 深度越大,表示存儲設備能夠同時處理的 I/O 請求越多,可能提高系統的吞吐量。

6.讀寫塊大小:

1.定義:每次 I/O 操作傳輸的數據塊大小。

2.重要性:讀寫塊大小對存儲設備的性能有顯著影響,不同的塊大小可能導致不同的 IOPS 和吞吐量。

三、進行壓測

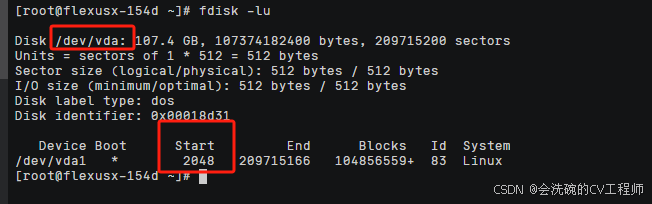

不過在測試之前,我們需要執行以下命令查看存儲設備是否已經 4KiB 對齊。如果不是 4KiB 對齊,則對性能影響較大。fdisk -lu 如果返回的 Start 值能夠被 8 整除則表示 4KiB 對齊。

?可以看得到,我們這里的 start 值為 2048,2048%4 = 0 是合適的。

執行以下命令,切換路徑。cd /tmp

3.1 測試全盤隨機讀 IO 延遲

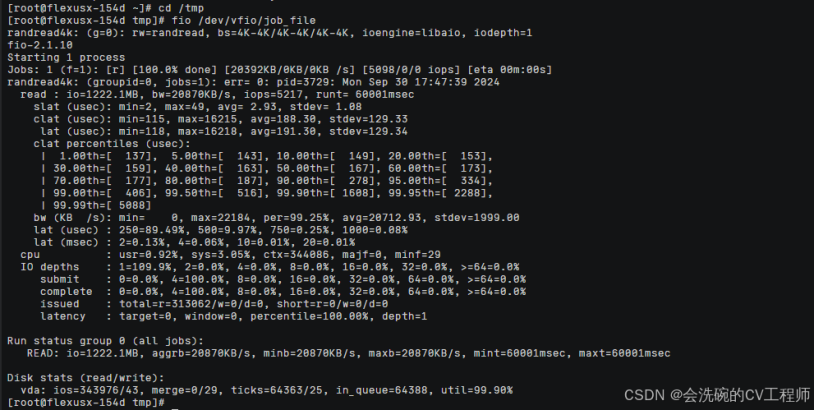

創建 job_file 文件測試隨機讀的 IO 延遲,文件內容如下。創建后,執行命令 fio job_file 查看測試結果。

[global]ioengine=libaiouserspace_reapruntime=60direct=1group_reportingrandrepeat=0norandommapramp_time=6iodepth=1numjobs=1exitall[randread4k]filename=/dev/vda1rw=randreadbs=4K

?這個測試結果是通過fio工具進行的隨機讀取測試,具體是針對 4KB 大小的塊進行的。以下是對測試結果的詳細解讀:

性能指標

·總讀取量:1222.1MB

·帶寬:20870KB/s(平均)

·IOPS:5217(每秒輸入輸出操作數)

延遲統計

·服務時間(slat):平均 2.93 微秒,標準差 1.08 微秒

·完成時間(clat):平均 188.30 微秒,標準差 129.33 微秒

·總延遲(lat):平均 191.30 微秒,標準差 129.34 微秒

·完成時間百分位數:

o1%:137 微秒

o5%:143 微秒

o10%:149 微秒

o...

o99.99%:5088 微秒(即 5.088 毫秒)

帶寬分布

·最小帶寬:0KB/s

·最大帶寬:22184KB/s

·99.25%的時間內,帶寬在 20712.93KB/s 左右

延遲分布

·250 微秒以內:89.49%

·500 微秒以內:99.46%(包括 250 微秒以內的)

·1 毫秒以內:99.60%(包括 500 微秒以內的)

·2 毫秒以內:99.73%(包括 1 毫秒以內的)

·...

CPU 使用情況

·用戶態 CPU 使用率:0.92%

·系統態 CPU 使用率:3.05%

IO 深度與提交/完成狀態

·所有 IO 操作都在 IO 深度為 1 時完成

·提交和完成操作都集中在 4 個塊大小(即 16KB)的批次上

磁盤統計

·vda(虛擬磁盤設備):

o讀取 IO 操作數:343976

o寫入 IO 操作數:43(很少,可能是元數據或后臺操作)

o合并讀取操作:0(沒有合并)

o合并寫入操作:29(有一些合并)

o隊列中時間:64388 個 ticks(表示磁盤忙碌程度)

o磁盤利用率:99.90%

總結

這個測試結果表明,在隨機讀取 4KB 塊的情況下,系統能夠達到約 20870KB/s 的帶寬和 5217 IOPS 的性能。延遲方面,大部分讀取操作在 250 微秒以內完成,99.99%的讀取操作在 5 毫秒以內完成。CPU 使用率相對較低,表明測試期間 CPU 不是瓶頸。磁盤利用率非常高,接近 100%,說明磁盤在測試期間幾乎一直在忙碌。

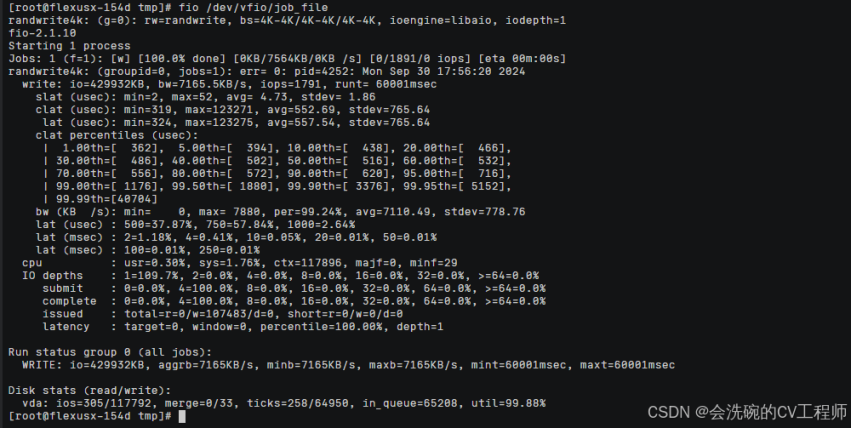

3.2 測試全盤隨機寫 IO 延遲

創建 job_file 文件測試隨機讀的 IO 延遲,文件內容如下。創建后,執行命令 fio job_file 查看測試結果。

[global]

ioengine=libaio

userspace_reap

time_based runtime=60

direct=1

group_reporting randrepeat=0

norandommap ramp_time=6

iodepth=1

numjobs=1

exitall

[randwrite4k]

filename=/dev/vda1

rw=randwrite bs=4K

?下面就是上述結果的解讀:

總體性能指標

·

o總寫入數據量:429932KB(約 420MB)

o平均帶寬:7165.5KB/s(或約 7.17MB/s)

o每秒 I/O 操作次數(IOPS):1791

o運行時間:60001 毫秒(60 秒)

·

提交時延(slat):

·

o最小值:2 微秒

o最大值:52 微秒

o平均值:4.73 微秒

o標準差:1.86 微秒

o提交時延主要由服務器處理器和操作系統決定,也受 SSD 的接口協議和工作模式影響。在這個測試中,提交時延非常低且穩定。

·

完成時延(clat):

·

o最小值:319 微秒

o最大值:123271 微秒(即 123.271 毫秒)

o平均值:552.69 微秒

o標準差:765.64 微秒

o完成時延主要由 SSD 決定,反映了從 I/O 提交到 I/O 完成的時長。在這個測試中,完成時延的波動較大,但平均值仍在可接受范圍內。

·

總時延(lat):

·

o最小值:324 微秒

o最大值:123275 微秒(即 123.275 毫秒)

o平均值:557.54 微秒

o標準差:765.64 微秒

o總時延是提交時延和完成時延之和,反映了從 fio 創建 I/O 到 I/O 完成的時長。

·最小帶寬:0KB/s(測試開始時)

·最大帶寬:7880KB/s

·帶寬利用率:99.24%

·平均帶寬:7110.49KB/s(與平均帶寬指標略有差異,但相差不大)

·標準差:778.76KB/s

·

CPU 使用率:

·

o用戶態:0.30%

o系統態:1.76%

o上下文切換次數:117896 次

oCPU 使用率較低,表明測試對 CPU 資源的消耗不大。

·

I/O 深度:

·

oI/O 深度為 1 時,占比為 109.7%(超過 100%可能是因為四舍五入或并發 I/O 請求數略有波動)

o其他 I/O 深度(2、4、8、16、32、>=64)的占比均為 0%

o這表明測試期間主要使用的是 I/O 深度為 1 的并發 I/O 請求。

·

磁盤 I/O 操作數:

·

o讀操作數:305 次

o寫操作數:117792 次

o合并讀操作數:0 次

o合并寫操作數:33 次

o磁盤主要忙于寫操作。

·

磁盤忙碌時間:

·

o讀操作忙碌時間:258 個 ticks

o寫操作忙碌時間:64950 個 ticks

o隊列中等待時間:65208 個 ticks

o磁盤利用率:99.88%

o磁盤在測試期間幾乎一直處于忙碌狀態。

這份 fio 測試結果表明,存儲系統在執行 4KB 大小的隨機寫入操作時表現出良好的性能。盡管完成時延存在一定的波動,但平均帶寬和 IOPS 均保持在較高水平。同時,CPU 使用率較低,磁盤利用率較高,表明測試期間存儲系統得到了充分的利用。

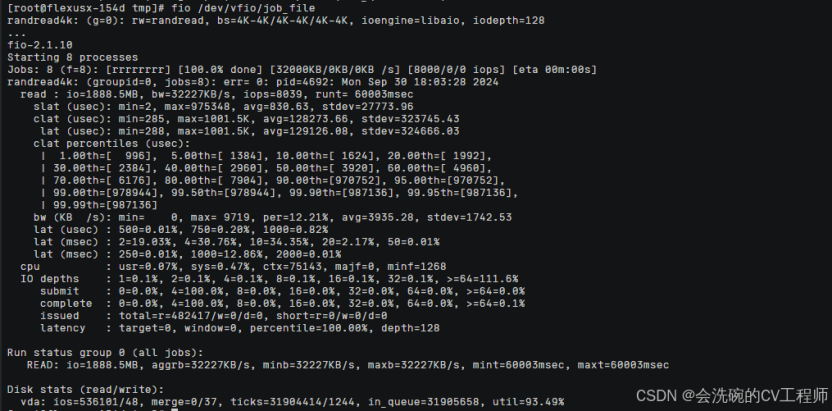

3.3 測試隨機讀 IOPS

創建 job_file 文件測試隨機讀的 IOPS,文件內容如下。創建后,執行命令 fio job_file 查看測試結果。

[global]ioengine=libaiouserspace_reaptime_basedruntime=60direct=1group_reportingrandrepeat=0norandommapramp_time=6iodepth=128numjobs=8exitall[randread4k]filename=/dev/vda1rw=randreadbs=4k

?這份 fio 測試結果提供了關于存儲系統在執行 4KB 大小的隨機讀取操作時的詳細性能數據。以下是對測試結果的詳細解讀:

總體性能指標

·總讀取數據量:1888.5MB

·平均帶寬:32227KB/s(或約 32.23MB/s)

·每秒 I/O 操作次數(IOPS):8039

·運行時間:60003 毫秒(60 秒)

時延分析

·提交時延(slat):

o最小值:2 微秒

o最大值:975348 微秒(即 0.975 秒)

o平均值:830.63 微秒

o標準差:27773.96 微秒

o提交時延的波動較大,但平均值仍在可接受范圍內。這可能是由于系統負載、中斷處理等因素導致的。

·完成時延(clat):

o最小值:285 微秒

o最大值:1001.5K 微秒(即 1001.5 毫秒或 1 秒)

o平均值:128273.66 微秒(即 128.27 毫秒)

o標準差:323745.43 微秒

o完成時延的波動非常大,且平均值較高。這表明存儲系統在處理隨機讀取請求時存在較大的延遲。

·總時延(lat):

o最小值:288 微秒

o最大值:1001.5K 微秒(即 1001.5 毫秒或 1 秒)

o平均值:129126.08 微秒(即 129.13 毫秒)

o標準差:324666.03 微秒

o總時延的波動和平均值都與完成時延相似,因為完成時延在總時延中占主導地位。

此外,測試還提供了時延的百分位數數據。例如,99.99%的 I/O 操作在 987136 微秒(即 0.987 毫秒)內完成,但需要注意的是,這里的 99.99%百分位數實際上受到了極端值的影響,因為大部分操作的完成時延都遠低于這個值。

帶寬分析

·最小帶寬:0KB/s(測試開始時)

·最大帶寬:9719KB/s

·帶寬利用率和平均值等數據在測試報告中未直接給出百分比形式,但可以通過計算得出。例如,平均帶寬為 3935.28KB/s(在多個并發 I/O 請求下測得),這表明存儲系統在測試期間能夠提供穩定的帶寬輸出。然而,與平均帶寬 32227KB/s(整體測試的平均值)相比,單個請求的帶寬波動較大。

磁盤統計信息

·磁盤 I/O 操作數:

o讀操作數:536101 次

o寫操作數:48 次(幾乎可以忽略不計)

o磁盤主要忙于讀操作。

·磁盤合并操作數:

o讀操作合并數:0 次(表明讀操作沒有被合并)

o寫操作合并數:37 次(但寫操作次數很少,所以合并操作的影響不大,因為這里我們主要測試的是隨機讀情況下的 IOPS)

·磁盤忙碌時間:

o讀操作忙碌時間:31904414 個 ticks(表明磁盤在測試期間幾乎一直處于忙碌狀態)

o寫操作忙碌時間:1244 個 ticks(很少)

o隊列中等待時間:31905658 個 ticks(與讀操作忙碌時間相近)

o磁盤利用率:93.49%(表明磁盤在測試期間得到了充分的利用)

這份 fio 測試結果表明,存儲系統在執行 4KB 大小的隨機讀取操作時,雖然能夠提供較高的平均帶寬和 IOPS,但完成時延的波動較大且平均值較高。但是這可能是由于存儲系統的內部機制、磁盤性能或系統負載等因素導致的。為了改善性能,可以考慮優化存儲系統的配置、升級硬件或降低系統負載等方法。同時,進行更多類型的測試(如順序讀、混合讀寫等)并分析測試結果也是很有必要的。 但整體下面我們主要測試的是隨機讀的情況下。

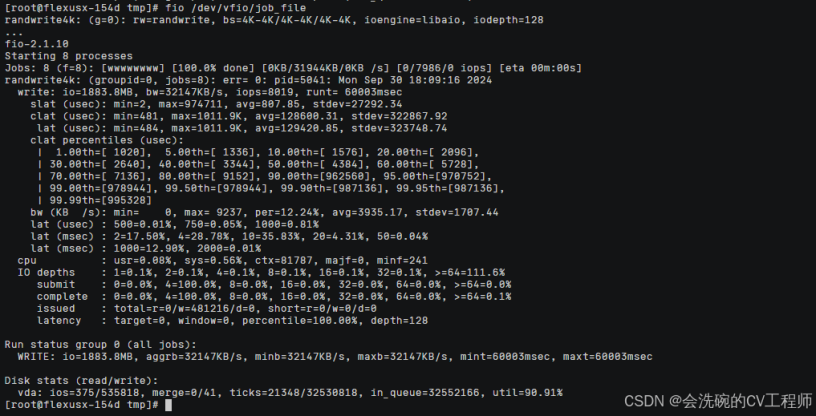

3.4 測試隨機寫 IOPS

創建 job_file 文件測試隨機寫的 IOPS,文件內容如下。創建后,執行命令 fio job_file 查看測試結果。

[global]ioengine=libaiouserspace_reaptime_basedruntime=60direct=1group_reportingrandrepeat=0norandommapramp_time=6iodepth=128numjobs=8exitall[randwrite4k]filename=/dev/vda1rw=randwritebs=4k

?

這份 fio 測試結果提供了關于存儲系統在執行 4KB 大小的隨機寫入操作時的詳細性能數據。以下是對測試結果的解讀:

總體性能指標

·總寫入數據量:1883.8MB

·平均帶寬:32147KB/s(或約 32.15MB/s)

·每秒 I/O 操作次數(IOPS):8019

·運行時間:60003 毫秒(60 秒)

時延分析

·提交時延(slat):

o最小值:2 微秒

o最大值:974711 微秒(即 0.975 秒)

o平均值:807.85 微秒

o標準差:27292.34 微秒

o提交時延的波動較大,但平均值在可接受范圍內,表明系統處理 I/O 請求的中斷和調度效率尚可。

·完成時延(clat):

o最小值:481 微秒

o最大值:1011.9K 微秒(即 1011.9 毫秒或 1 秒多)

o平均值:128600.31 微秒(即 128.6 毫秒)

o標準差:322867.92 微秒

o完成時延的波動非常大,且平均值較高。這表明存儲系統在處理隨機寫入請求時存在較大的延遲,可能是由于磁盤性能瓶頸、存儲系統內部處理機制或系統負載等因素導致的。

·總時延(lat):

o最小值:484 微秒

o最大值:1011.9K 微秒(即 1011.9 毫秒或 1 秒多)

o平均值:129420.85 微秒(即 129.42 毫秒)

o標準差:323748.74 微秒

o總時延的波動和平均值與完成時延相似,因為完成時延在總時延中占主導地位。

此外,測試還提供了時延的百分位數數據。例如,99.99%的 I/O 操作在 995328 微秒(即 0.995 毫秒)內完成,但需要注意的是,這里的 99.99%百分位數實際上受到了極端值的影響,因為大部分操作的完成時延都遠低于這個值。

帶寬分析

·最小帶寬:0KB/s(測試開始時)

·最大帶寬:9237KB/s

·平均帶寬利用率和值等數據表明,存儲系統在測試期間能夠提供穩定的帶寬輸出,但單個請求的帶寬波動較大。

CPU 和 I/O 深度

·CPU 使用率:

o用戶態:0.08%

o系統態:0.56%

oCPU 使用率非常低,表明測試對 CPU 資源的消耗很小。

·I/O 深度:

o在測試期間,主要使用的是 I/O 深度大于等于 64 的并發 I/O 請求(占比 111.6%,超過 100%可能是因為四舍五入或并發 I/O 請求數略有波動)。

o提交和完成 I/O 請求時,主要使用的是 4KB 大小的塊(占比 100%)。

磁盤統計信息

·磁盤 I/O 操作數:

o讀操作數:375 次(很少,因為主要是寫入測試)

o寫操作數:535818 次

o磁盤主要忙于寫操作。

·磁盤合并操作數:

o讀操作合并數:0 次

o寫操作合并數:41 次(寫操作合并次數相對較多,但考慮到寫操作總數很大,合并比例仍然很低,因為我們這里主要是測試隨機寫的 IOPS)

·磁盤忙碌時間:

o讀操作忙碌時間:21348 個 ticks(很少)

o寫操作忙碌時間:32530818 個 ticks(表明磁盤在測試期間幾乎一直處于忙碌狀態)

o隊列中等待時間:32552166 個 ticks(與寫操作忙碌時間相近)

o磁盤利用率:90.91%(表明磁盤在測試期間得到了充分的利用)

綜上所述,這份 fio 測試結果表明,存儲系統在執行 4KB 大小的隨機寫入操作時,雖然能夠提供較高的平均帶寬和 IOPS,但完成時延的波動較大且平均值較高。這可能是由于存儲系統的內部機制、磁盤性能或系統負載等因素導致的。為了改善性能,可以考慮優化存儲系統的配置、升級硬件(如使用更快的 SSD)、調整 I/O 調度策略或降低系統負載等方法。同時,進行更多類型的測試(如順序寫、混合讀寫等)并分析測試結果也是很有必要的。

整體感覺來說,還是非常不錯的,帶寬方面也可以提供穩定輸出,且磁盤的隨機讀寫性能都非常好。

結合上面測評來說,華為云 Flexus 云服務器 X 實例以其柔性算力、高性能加速、成本優化和安全可靠等特點,成為中小企業在 828 企業節期間選擇云服務的優選之一。如果您正在尋找一款性價比高、性能卓越的云服務器產品,不妨考慮華為云 Flexus 云服務器 X 實例。點擊下方卡片立即跳轉查看吧:

Flexus云服務器X實例-華為云Flexus云服務器X實例(Flexus X)是柔性算力,六倍性能,旗艦體驗,覆蓋高科技、零售、金融、游戲等行業大多數通用工作負載場景。

https://www.huaweicloud.com/product/flexus-x.html

審核編輯 黃宇

-

云服務器

+關注

關注

0文章

726瀏覽量

13422 -

華為云

+關注

關注

3文章

2682瀏覽量

17586

發布評論請先 登錄

相關推薦

Flexus 云服務器 X 實例實踐:安裝 SimpleMindMap 思維導圖工具

Flexus 云服務器 X 實例實踐:安裝 Ward 服務器監控工具

利用 FIO 工具測試 Flexus 云服務器 X 實例存儲性能

利用 FIO 工具測試 Flexus 云服務器 X 實例存儲性能

評論