提高機器學習模型的可解釋性和透明度,將有助于模型的除錯、引導未來的數據收集方向、為特征構建和人類決策提供真正可靠的信息,最終在人與模型之間建立信任。

過去幾年來,人工智能研究人員在圖像識別、自然語言理解和棋類等領域取得了重大突破。但由于缺乏對復雜機器學習模型的真正理解,導致模型在傳播時出現了偏見,這種偏見在零售、面部識別和語言理解等領域的應用中出現了多次。

說到底,機器學習模型大多數時候仍然是“黑盒子”,很多時候可以拿來用,但具體原理并不十分清楚,即缺乏足夠的“可解釋性”。

什么是模型的”可解釋性“?不同人群定義不一樣

所謂模型的可解釋性,是指人類能夠在何種程度上一致地估計、理解并遵循模型的預測,以及在模型出錯時,在何種程度上能夠成功檢測到。

可解釋性對不同的人群有著不同的含義:

對于數據科學家來說,意味著更好地理解模型,掌握模型性能好壞情況以及原因。這些信息有助于數據科學家構建性能更強大的模型。

對于業務利益相關者而言,模型具備可解釋性有助于深入了解為什么人工智能系統做出特定決定以確保公平性,維護用戶和品牌。

對于用戶來說,這意味著要理解模型做出決策的原因,并在模型出錯時允許進行有意義的挑戰。

對于專家或監管機構來說,它意味著審核AI系統并遵循決策流程,尤其是在系統出現問題時。

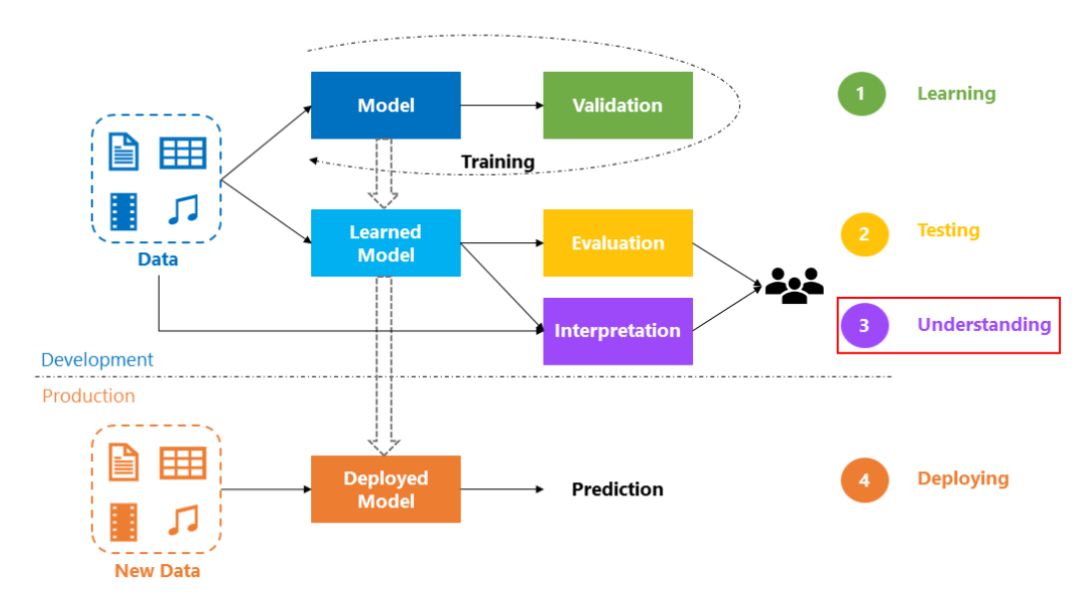

微軟的團隊數據科學流程(TDSP),其中一個重要環節就是對模型的理解

機器學習模型的可解釋性可以展示模型正在學習什么內容,而洞悉模型的內部,要比大多數人預想的更加有用。

在過去的10年里,我采訪了許多數據科學家,其中模型可解釋性技術是我最喜歡的主題,在這一問題上,甚至可以將最優秀的數據科學家與普通科學家區分開來。

有些人認為機器學習模型是黑盒子,可以做出預測,但卻無法理解。但最好的數據科學家知道如何從任何模型中提取出關于真實世界的見解。對于任何給定的模型,優秀的數據科學家可以輕松回答類似下面的問題:

模型認為哪些特征最重要?

對于來自模型的任何預測來說,數據的每個特征會對預測結果產生哪些影響?

不同特征之間的哪些相互作用對模型的預測結果影響最大?

回答這些問題比許多人意識到的更為廣泛。無論你是從Kaggle學習技術還是從統計學習元素這樣的綜合資源中學習,這些技術都將徹底改變構建,驗證和部署機器學習模型的方式。

提高模型可解釋性有什么用?

關于模型的可解釋性技術,以下是五個最重要的應用方式:

調試

為模型特征構建提供信息

指導未來的數據收集方向

為人類決策提供建議

在人與模型間建立信任

調試

世界上存在很多可靠性不高,雜亂無章、數量眾多的數據。在編寫預處理代碼時,這些數據可能會成為潛在的錯誤源頭,增加目標泄漏的可能性,在實際數據科學項目中的某些時候出現錯誤可以說是一種常態,而不是例外。

由于錯誤出現的頻率和潛在的災難性后果,除錯是數據科學中最有價值的技能之一。了解模型發現的模式將幫助你確定,模型對現實世界的理解與你自己的觀點出現了不一致,而這通常是查找錯誤的第一步。

為模型的特征構建提供信息

特征構建通常是提高模型精度的最有效的方法。這個過程通常涉及使用原始數據或先前創建的特征的轉換重復創建新特征。

有時你可以只憑借關于底層主題的直覺來完成這個過程。但是,當模型有100個原始特征或缺乏有關您正在處理的主題的背景知識時,就需要更多指引了。這時候,如果模型仍是黑盒子,不可解釋的,完成這一過程可能會非常困難,甚至是不可能的。

未來,隨著越來越多的數據集的原始特征數量達到成百上千的級別,這種方式無疑會變得越來越重要。

指導未來的數據收集方向

對于從網上下載的數據集,你并沒有控制能力。但是,許多利用數據科學的企業和組織都有機會擴展其收集的數據類型。收集新類型的數據可能成本高昂,又不方便,因此只有在知道某類數據值得收集,他們才會去這樣做。

如果模型是可解釋的,就可以很好地理解當前特征的價值,進而更有可能推斷出哪些新型數據是最有用的,從而指導未來數據的收集方向。

為人類決策提供建議

有些決策行為是由模型自動完成的。比如,當你訪問亞馬遜的網站時,你所看到的網頁內容并不是由真人匆忙決定的。不過,確實許多重要的決定都是由人做出的。對于這些決策,觀點洞察可能比預測結果更有價值。

在人與模型間建立信任

在沒有驗證一些基本事實的情況下,許多人認為他們無法信任模型來進行重要決策。考慮到數據出現錯誤的幾率,這是一個明智的預防措施。

在實際應用中,如果模型顯示的結果符合他們對問題的一般見解,將有助于在人與模型間建立一種信任,即使對數據科學知之甚少的人而言也是如此。

不過,在Adrian Weller的一篇有趣的論文中,提出AI透明度應該是實現目標的手段,而不是目標本身。Weller認為,更高的模型透明度可能產生對所有人不利的結果,并可能使AI被惡意者濫用。

毫無疑問,AI系統必須足夠安全,并且能夠防范對抗性攻擊,這樣,討論模型的可解釋性和透明度才是有積極意義的。

-

人工智能

+關注

關注

1796文章

47666瀏覽量

240286 -

模型

+關注

關注

1文章

3305瀏覽量

49221 -

機器學習

+關注

關注

66文章

8438瀏覽量

133084

原文標題:告別AI模型黑盒子:可解釋性將是數據科學的下一個“超能力”

文章出處:【微信號:AI_era,微信公眾號:新智元】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

如何讓陪伴機器人更懂家庭

【「具身智能機器人系統」閱讀體驗】2.具身智能機器人大模型

《具身智能機器人系統》第7-9章閱讀心得之具身智能機器人與大模型

麻省理工學院推出新型機器人訓練模型

AI大模型與深度學習的關系

AI大模型與傳統機器學習的區別

構建語音控制機器人 - 線性模型和機器學習

讓機器學習模型不再是”黑盒子“

讓機器學習模型不再是”黑盒子“

評論