分布外魯棒性

我們討論的第三種能力是分布外的魯棒性。在 2018 年至 2022 年期間,NLP、CV 和通用機(jī)器學(xué)習(xí)領(lǐng)域有大量關(guān)于分布偏移/對(duì)抗魯棒性/組合生成的研究,人們發(fā)現(xiàn)當(dāng)測(cè)試集分布與訓(xùn)練分布不同時(shí),模型的行為性能可能會(huì)顯著下降。然而,在大型語(yǔ)言模型的上下文學(xué)習(xí)中似乎并非如此。Si 等人在2022年的研究顯示 :

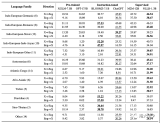

數(shù)據(jù)來(lái)自于 Si et. al. 2022. 雖然 GPT-3 在同分布設(shè)置下比 RoBERTa 要差,但在非同分布設(shè)置下優(yōu)于 RoBERTa,性能下降明顯更小。

同樣,在此實(shí)驗(yàn)中,同分布情況下基于提示詞的 GPT-3 的效果并沒有精調(diào)后的 RoBERTa要好。但它在三個(gè)其他分布(領(lǐng)域切換、噪聲和對(duì)抗性擾動(dòng))中優(yōu)于 RoBERTa,這意味著 GPT3 更加魯棒。

此外,即使存在分布偏移,好的提示詞所帶來(lái)的泛化性能依舊會(huì)繼續(xù)保持。比如:

圖片來(lái)自于 Fu et. al. 2022. 即使測(cè)試分布與訓(xùn)練分布不同,復(fù)雜提示也始終比簡(jiǎn)單提示的表現(xiàn)更好。

Fu 等人2022年 的研究顯示,輸入提示越復(fù)雜,模型的性能就越好。這種趨勢(shì)在分布轉(zhuǎn)移的情況下也會(huì)繼續(xù)保持:無(wú)論測(cè)試分布與原分布不同、來(lái)自于噪聲分布,或者是從另一個(gè)分布轉(zhuǎn)移而來(lái)的,復(fù)雜提示始終優(yōu)于簡(jiǎn)單提示。

到目前為止的總結(jié)

在上文中,我討論了只有大型模型才有的三種突現(xiàn)能力。它們是:

- 復(fù)雜推理,大型模型在沒有使用全部訓(xùn)練數(shù)據(jù)的情況下便顯著優(yōu)于以前的小型模型。

- 知識(shí)推理,大型模型可能沒有小模型效果好,但大模型不需要額外的知識(shí)來(lái)源(知識(shí)可能很昂貴,或者很難從非結(jié)構(gòu)化數(shù)據(jù)中抽取)。

- 分布外魯棒性,這是之前進(jìn)行模型精調(diào)時(shí)需要努力解決的問題。大型模型雖然在同分布情況下的效果不如以前的方法,但非同分布情況下的泛化性能卻好得多。

突現(xiàn)能力推翻比例定律

鑒于上文列出的優(yōu)點(diǎn),大家可能會(huì)開始覺得大型語(yǔ)言模型確實(shí)很好了。在進(jìn)一步討論之前,讓我們?cè)倩仡櫼幌轮暗墓ぷ鳎蜁?huì)發(fā)現(xiàn)一個(gè)很奇怪的問題: GPT-3 在 2020 年就發(fā)布了,但為什么直到現(xiàn)在我們才發(fā)現(xiàn)并開始思考范式的轉(zhuǎn)變 ?

這個(gè)問題的答案就藏在兩種曲線中:對(duì)數(shù)線性曲線和相變曲線。如下圖:

左圖: 比例定律. 當(dāng)模型大小呈指數(shù)增長(zhǎng)時(shí),相應(yīng)的模型性能呈線性增長(zhǎng)。右圖: 當(dāng)模型尺寸達(dá)到一定規(guī)模時(shí),會(huì)出現(xiàn)突現(xiàn)能力,讓性能急劇增加。

最初,(OpenAI)的研究者認(rèn)為語(yǔ)言模型的性能與模型尺寸的關(guān)系可以通過對(duì)數(shù)線性曲線預(yù)測(cè),即模型尺寸呈指數(shù)增長(zhǎng)時(shí),性能會(huì)隨之線性增加。這種現(xiàn)象被稱為語(yǔ)言模型的縮放定律,正如 Kaplan 等人在2020年 最初的GPT3文章 中討論的那樣。

重要的是,在那個(gè)階段,即便最大的 GPT-3 在有提示的情況下也不能勝過小模型精調(diào)。所以當(dāng)時(shí)并沒有必要去使用昂貴的大模型(即使提示詞的標(biāo)注效率很高)。

直到2021年,Cobbe 等人 發(fā)現(xiàn)縮放定律同樣適用于精調(diào)。這是一個(gè)有點(diǎn)悲觀的發(fā)現(xiàn),因?yàn)樗馕吨?我們可能被鎖定在模型規(guī)模上 ——雖然模型架構(gòu)優(yōu)化可能會(huì)在一定程度上提高模型性能,但效果仍會(huì)被鎖定在一個(gè)區(qū)間內(nèi)(對(duì)應(yīng)模型規(guī)模),很難有更顯著的突破。

在縮放定律的掌控下(2020年到2021),由于GPT-3無(wú)法勝過精調(diào) T5-11B,同時(shí)T5-11B微調(diào)已經(jīng)很麻煩了,所以NLP社區(qū)的關(guān)注點(diǎn)更多的是研究更小的模型或者高效參數(shù)適應(yīng)。Prefix tuning 就是提示和適應(yīng)交叉的一個(gè)例子,后來(lái)由 He 等人在 2021 統(tǒng)一。當(dāng)時(shí)的邏輯很簡(jiǎn)單:如果精調(diào)效果更好,我們就應(yīng)該在高效參數(shù)適應(yīng)上多下功夫;如果提示詞的方法更好,我們應(yīng)該在訓(xùn)練大型語(yǔ)言模型上投入更多精力。

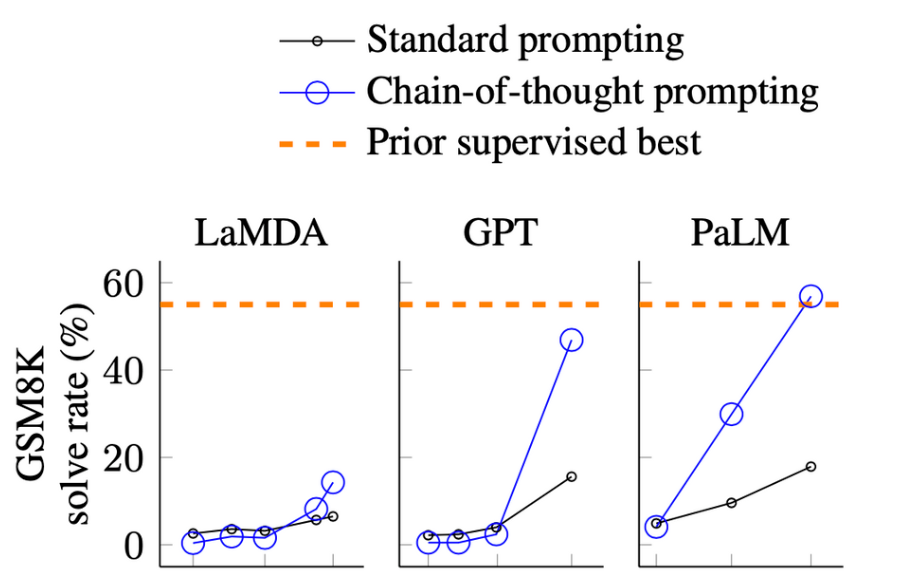

之后在 2022 年 1 月,思維鏈的工作被放出來(lái)了。正如作者所展示的那樣,思維鏈提示在性能-比例曲線中表現(xiàn)出明顯的 相變 。當(dāng)模型尺寸足夠大時(shí),性能會(huì)顯著提高并明顯超越比例曲線。

當(dāng)使用思維鏈進(jìn)行提示時(shí),大模型在復(fù)雜推理上的表現(xiàn)明顯優(yōu)于微調(diào),在知識(shí)推理上的表現(xiàn)也很有競(jìng)爭(zhēng)力,并且分布魯棒性也存在一定的潛力。要達(dá)到這樣的效果只需要8個(gè)左右的示例,這就是為什么范式可能會(huì)轉(zhuǎn)變的原因。

范式轉(zhuǎn)變意味著什么?

范式轉(zhuǎn)變究竟意味著什么?下面我們給出精調(diào)和提示詞方法的對(duì)比:

提示詞的好處很明顯:我們不再需要繁瑣的數(shù)據(jù)標(biāo)注和在全量數(shù)據(jù)上進(jìn)行精調(diào),只需要編寫提示詞并獲得滿足要求的結(jié)果,這比精調(diào)要快很多。

另外要注意的兩點(diǎn)是:

上下文學(xué)習(xí)是監(jiān)督學(xué)習(xí)嗎?

- 坦白講,我不確定。

- 相似之處在于,上下文學(xué)習(xí)也需要像訓(xùn)練數(shù)據(jù)一樣的示例

- 不同之處在于,上下文學(xué)習(xí)的泛化行為并不同于監(jiān)督學(xué)習(xí),這使得之前的泛化理論(例如 Rademancher Complexity 或 Neural Tangent Kernel)均不適用。

上下文學(xué)習(xí)真的比監(jiān)督學(xué)習(xí)效果要好嗎?

- 答案還未知。

- 大多數(shù)提示詞和精調(diào)的對(duì)比都只比了 提示詞+大模型 vs 精調(diào)+小模型,但公平的對(duì)比應(yīng)該是 提示詞+大模型 vs 精調(diào)+大模型,且對(duì)比時(shí)的基座模型應(yīng)該一樣。所以在最初的思維鏈文章中,如果 Wei 等人要說(shuō)明提示詞好于精調(diào),他們應(yīng)該對(duì)比精調(diào)后的PaLM,而不是GPT3。

- 我的假設(shè)是:精調(diào)可以提高分布內(nèi)的性能,但會(huì)損害分布外的魯棒性。提示詞在分布變化的場(chǎng)景中表現(xiàn)更好,但在同分布場(chǎng)景下不如精調(diào)。

- 如果假設(shè)是真的,那么一個(gè)值得研究的問題就是如何在不犧牲其上下文學(xué)習(xí)能力的情況下進(jìn)行精調(diào)

- 注意分布外精調(diào)的效果同樣會(huì)隨著模型尺寸變化 。比如 Yang 等人在2022年的工作中,第四張表就顯示,Bart-based的分布外泛化能力會(huì)下降,但Bart-large則提升。對(duì)于大模型,當(dāng)測(cè)試集的分布和訓(xùn)練集相差不大時(shí),同分布的精調(diào)效果也應(yīng)該會(huì)提升。

再回顧一下前文提到的的邏輯:如果精調(diào)更好,我們應(yīng)該努力研究如何進(jìn)行參數(shù)高效的優(yōu)化;如果提示詞更好,我們應(yīng)該努力去訓(xùn)練更好的大型語(yǔ)言模型。

所以,盡管我們相信大型語(yǔ)言模型有巨大的潛力,仍然沒有確鑿的證據(jù)表明精調(diào)和提示詞哪種方法更好,因此我們不確定范式是否真的應(yīng)該轉(zhuǎn)變、或應(yīng)該轉(zhuǎn)變到什么程度。仔細(xì)比較這兩種范式,使我們對(duì)未來(lái)有一個(gè)清晰的認(rèn)識(shí),是非常有意義的。我們將更多討論留到下一篇文章。

模型應(yīng)該多大才夠?

兩個(gè)數(shù)字:62B 和 175B。

- 模型至少需要62B,使思維鏈的效果才能大于標(biāo)準(zhǔn)的提示詞方法。

- 模型至少需要175B(GPT3的尺寸),思維鏈的效果才能大于精調(diào)小模型(T5 11B)的效果。

62B這個(gè)數(shù)字來(lái)自于 Chung 等人 2022 年工作的第五張表 :

對(duì)于所有小于62B的模型,直接用提示詞都好于思維鏈 。第一個(gè)用思維鏈更好的模型是 Flan-cont-PaLM 62B 在BBH上的結(jié)果。540B的模型使用思維鏈會(huì)在更多任務(wù)上得到好的效果,但也不是全部任務(wù)都好于精調(diào)。另外,理想的尺寸可以小于 540B,在 Suzgun 等人2022年 的工作中,作者展示了175B的 InstructGPT 和 175B的 Codex 使用思維鏈都好于直接用提示詞。綜合以上結(jié)果,我們得到了63B和175B兩個(gè)數(shù)字。所以,如果想要參與這場(chǎng)游戲,首先要有一個(gè)大于平均尺寸的模型。

不過,還有其他大型模型在思維鏈下的表現(xiàn)差了很多,甚至不能學(xué)到思維鏈,比如 OPT、BLOOM 和 GPT-3 的第一個(gè)版本。他們的尺寸都是175B。這就引出了我們下一個(gè)要討論的問題。

規(guī)模是唯一的因素嗎?

不是。

規(guī)模是一個(gè)必要但不充分的因素。有些模型足夠大(比如 OPT 和 BLOOM,都是 175B),但并不能做思維鏈。

有兩種模型可以做思維鏈 (TODO: add discussions about UL2):

- GPT3系列的模型,包括 text-davinci-002 和 code-davinci-002 (Codex)。 這是僅有的兩個(gè)具有強(qiáng)大突現(xiàn)能力并可公開訪問的模型 。

- 除了以上兩個(gè)模型,其他GPT3模型,包括原來(lái)的GPT3,text-davinci-001,以及其他更小的GPT-3模型,都不能做思維鏈。

- 當(dāng)說(shuō)“能做思維鏈”時(shí),我們是指使用思維鏈方法的效果比直接用提示詞、精調(diào)T5-11B效果更好。

- 另外要注意的是,code-davinci-002 在語(yǔ)言任務(wù)上的性能始終優(yōu)于 text-davinci-002。這個(gè)觀察非常有趣且耐人尋味。這表明 基于代碼數(shù)據(jù)訓(xùn)練的語(yǔ)言模型可以勝過根據(jù)語(yǔ)言訓(xùn)練的語(yǔ)言模型 。目前為止我們還不知道是為什么。

- PaLM系列模型,包括 PaLM、U-PaLM、Flan-PaLM 和 Minerva。這些模型目前還未開放訪問(此處@谷歌,快開源吧)。

為什么會(huì)有突現(xiàn)能力目前還不清楚,但我們找出了一下可能產(chǎn)生突現(xiàn)能力的因素:

- 指令精調(diào):GPT-3 text-davinci-002 就是用指令+強(qiáng)化學(xué)習(xí)精調(diào) 的產(chǎn)物。在這之前,text-davinci-001 做思維鏈的效果并不好。同時(shí)PaLM 在經(jīng)過指令精調(diào) 后的效果也有提升。

- 在代碼上精調(diào):Codex code-davinci-002 是在代碼上進(jìn)行精調(diào)的,它的效果持續(xù)好于 text-davinci-002。PaLM 也在代碼上進(jìn)行了調(diào)整。從表面上看,代碼與語(yǔ)言關(guān)系不大,但似乎起了很大作用,我們會(huì)在之后的文章進(jìn)行討論。

- 用思維鏈精調(diào):在 text-davinci-002 發(fā)布時(shí),谷歌已經(jīng)發(fā)布 PaLM 3 個(gè)月了。所以 OpenAI 應(yīng)該看到了思維鏈相關(guān)的工作。還有一些工作表明,直接用思維鏈數(shù)據(jù)進(jìn)行精調(diào)可以激發(fā)模型的思維鏈能力。

然而,所有這些因素在現(xiàn)階段都是推測(cè)。揭示如何訓(xùn)練才能讓模型產(chǎn)生突現(xiàn)能力是非常有意義的,我們將更多討論留[下一篇文章。

總結(jié)

在本文中,我們仔細(xì)研究了語(yǔ)言模型的突現(xiàn)能力。我們強(qiáng)調(diào)了復(fù)雜推理、知識(shí)推理和分布外魯棒性的重要性和其中存在的機(jī)會(huì)。突現(xiàn)能力是非常令人興奮的,因?yàn)樗鼈兛梢猿奖壤桑⒃诒壤€中表現(xiàn)出相變。我們?cè)敿?xì)討論了研究范式是否會(huì)真的從精調(diào)轉(zhuǎn)向上下文學(xué)習(xí),但我們目前還沒有確切答案,因?yàn)榫{(diào)和上下文學(xué)習(xí)在分布內(nèi)、分布外場(chǎng)景下的效果仍有待對(duì)比。最后,我們討論了產(chǎn)生突現(xiàn)能力的三個(gè)潛在因素:指令精調(diào)、代碼精調(diào)和思維鏈精調(diào)。非常歡迎大家提出建議和討論。

英文原版:https://franxyao.github.io/blog.html

作者: 符堯 ,yao.fu@ed.ac.uk,愛丁堡大學(xué) (University of Edinburgh) 博士生,本科畢業(yè)于北京大學(xué)

與 Tushar Khot ,彭昊 在艾倫人工智能研究院 (Allen Institute for AI) 共同完成英文原稿

與 李如寐 (美團(tuán)NLP中心)共同翻譯為中文

感謝 Aristo teammates , Jingfeng Yang , 和 Yi Tay 的討論與建議。

電子發(fā)燒友App

電子發(fā)燒友App

評(píng)論