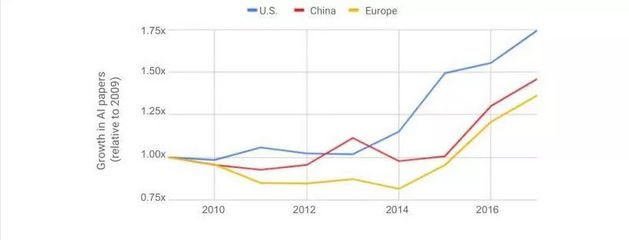

偏振圖像融合旨在通過光譜信息和偏振信息的結合改善圖像整體質量,在圖像增強、空間遙感、目標識別和軍事國防等領域具有廣泛應用。

據麥姆斯咨詢報道,近期,長春理工大學電子信息工程學院的科研團隊在《紅外技術》期刊上發表了以“深度學習偏振圖像融合研究現狀”為主題的文章。該文章第一作者和通訊作者為段錦教授。

本文在回顧基于多尺度變換、稀疏表示和偽彩色等傳統融合方法基礎上,重點介紹基于深度學習的偏振圖像融合方法研究現狀。首先闡述基于卷積神經網絡和生成對抗網絡的偏振圖像融合研究進展,然后給出在目標檢測、語義分割、圖像去霧和三維重建領域的相關應用,同時整理公開的高質量偏振圖像數據集,最后對未來研究進行展望。

傳統偏振融合方法

基于多尺度變換

基于多尺度變換(MST)的偏振圖像融合方法研究開始較早且應用廣泛。2016年,中北大學提出一種紅外偏振與強度圖像融合算法,融合結果能夠保留紅外強度圖像的全部特征和大部分偏振圖像的特征。2017年,提出一種基于離散小波變換(DWT)、非下采樣輪廓波變換(NSCT)以及改進主成分分析(PCA)的多算法協同組合的融合方法,該方法考慮到了3種算法的互補協同關系,能夠充分保留源圖像的重要目標和細節信息。2020年,提出一種基于小波和輪廓波變換的偏振圖像融合算法,解決了信息保留不充分、偏振圖像干擾視覺觀察和紋理細節不理想等問題。同年,有研究者針對中波紅外偏振圖像特點,提出一種基于小波變換的融合方法,根據圖像的高低頻特點選擇不同的融合規則,獲得了高分辨率的融合圖像。2022年,提出一種水下偏振圖像融合算法,融合圖像具有突出的細節和更高的清晰度。2023年,提出一種多尺度結構分解的圖像融合方法,將紅外圖像和偏振圖像分解為平均強度、信號強度和信號結構并分別采用不同的融合策略,實驗結果能保留更多的紋理細節,對比度得到有效提升并抑制偽影。

基于稀疏表示

基于稀疏表示(SR)的融合方法主要利用偏振圖像稀疏性,將圖像分解為基礎矩陣和稀疏系數矩陣后,再利用逆稀疏性原理進行重構,能夠實現偏振信息和空間信息的充分融合。2015年,將MST和SR相結合提出一種通用的圖像融合框架,然后在多聚焦、可見光和紅外以及醫學圖像融合任務中進行驗證,并與6種多尺度分析方法的融合效果進行比較。2017年,天津大學提出一種基于雙樹復小波變換(DTCWT)和SR的偏振圖像融合方法。利用絕對值最大值策略融合高頻部分,低頻部分則利用稀疏系數的位置信息判斷共有特征和特有特征,并分別制定相應策略,融合圖像具有較高對比度和細節信息。2021年,提出一種雙變量二維的經驗模態分解和稀疏表示相結合的紅外偏振圖像融合方法。通過絕對值最大策略融合高頻分量,有效地保留了細節信息。利用SR提取低頻分量間的共同特征和新特征,并制定適當的融合規則進行組合,融合結果在視覺感受和定量分析都更具有優勢,如圖1所示。

圖1 基于SR的不同場景融合結果

基于淺層神經網絡

基于淺層神經網絡的偏振圖像融合方法主要利用了脈沖耦合神經網絡(PCNN),通過脈沖編碼信號進行信息的傳遞和處理,也通常與多尺度變換方法結合設計。2013年,提出一種改進PCNN模型的偏振圖像融合算法,利用偏振參數圖像生成帶有目標細節的融合圖像進行偏振信息分析,同時使用匹配度M作為融合規則,獲得了能夠保留更多細節信息的高質量融合圖像。2018年,提出一種基于二維經驗模式分解(BEMD)和自適應PCNN的偏振圖像融合算法,首先將線偏振度圖像和偏振角圖像進行融合得到偏振特征圖像,然后將其與強度圖像進行分解,最后高低頻分量分別利用局部能量和區域方差自適應的融合策略。實驗結果表明,提出的算法在多項評價指標上更具有優勢。2020年,結合非下采樣剪切波變換和參數自適應簡化型脈沖耦合神經網絡提出一種水下偏振圖像融合方法,能夠有效探測到水下目標物的更多細節和顯著特征,在主觀視覺和客觀評價上都得到明顯提升,融合結果如圖2所示。

圖2 基于PCNN的不同場景融合結果

基于偽彩色

基于偽彩色的偏振圖像融合方法可以將目標或場景的熱輻射信息轉換為符合人類視覺感受的色彩,能夠有效提高成像效果。2006年,采集665 nm波段的航空遙感偏振圖像,并對地物場景進行上色,成功區分了陸地、海面和房屋等顯著區域。2007年,西北工業大學提出一種基于偽彩色映射和線偏振度熵的自適應加權多波段偏振圖像融合方法,通過將不同波段的Stokes圖像和DoLP圖像結合,有效地去除了背景雜波。同年,提出一種綜合偽彩色映射和小波變換的融合方法,將其應用在全色圖像和光譜圖像的融合任務中,在顯著增強目標與背景對比度的同時可以保留目標信息。2010年,結合非負矩陣分解和IHS顏色模型提出一種偏振圖像融合方法,具有較好的色彩表達和目標細節增強能力。隨后,他們提出一種基于顏色轉移和聚類分割的偽彩色圖像融合方法,融合結果符合視覺感知,同時可以使人工目標在雜亂背景下的對比度更加突出。2012年,提出一種針對紅外偏振和紅外光強圖像的偽彩色融合方法,并通過實驗證明了在多項指標中的明顯優勢。近些年,北京理工大學在該領域開展較多研究,取得了豐富的研究成果。

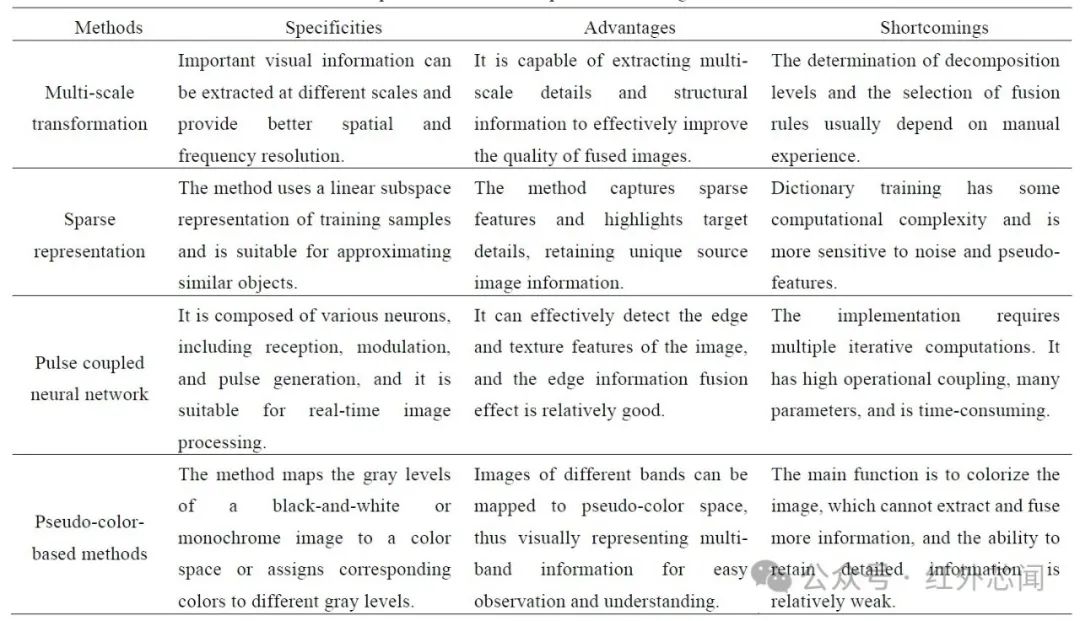

傳統融合方法對比分析

以上4種類型融合方法都具有各自的優缺點,方法對比如表1所示。在實際應用中,通常可以根據應用場景將這些方法相互結合進行算法的設計。

表1 傳統偏振圖像融合方法對比

深度學習偏振融合方法

基于卷積神經網絡

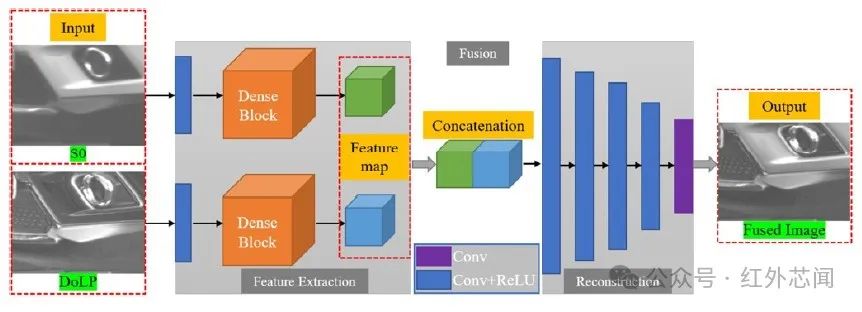

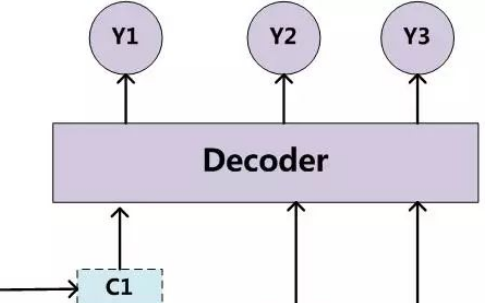

基于CNN的偏振圖像融合方法具有較為突出的融合效果。2017年,提出一種雙流型CNN用于高光譜圖像和SAR圖像的融合任務,并通過實驗證明了提出的網絡能夠較好地平衡和融合源圖像的互補信息。2020年,中南大學在可見光單波段的偏振融合任務中提出一種無監督的深度學習網絡(PFNet),網絡結構如圖3所示。其中,PFNet包括特征提取、融合和重構模塊,同時通過密集塊和多尺度加權結構相似度損失函數提高了網絡性能。PFNet能夠學習端到端的映射,進而實現強度圖像和偏振度圖像的充分融合,而無需考慮融合圖像的真實值,具有能夠避免復雜的水平測量和融合規則設計等優點。

圖3 PFNet網絡架構

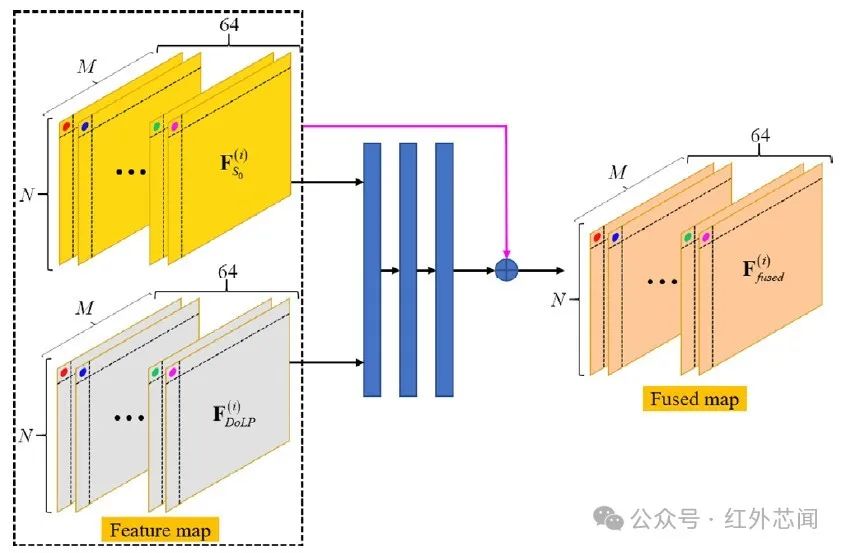

2021年,提出一種結合NSCT 和CNN的偏振圖像融合算法。首先利用快速引導濾波和脈沖耦合神經網絡對偏振角圖像進行去噪,然后將其與線偏振度圖像融合得到偏振特征圖像,最后通過多尺度變換的方法生成融合圖像。同年,中南大學對PFNet進行改進,提出一種自學習策略的深度卷積網絡。相較于PFNet,主要改進內容是在網絡結構中構建一個融合子網絡替代原來的連接方式。融合子網絡的設計借鑒了殘差結構,采用3層帶有RELU激活函數的卷積層,如圖4所示。同時,使用修正的余弦相似度損失函數代替平均絕對誤差損失,能夠更好地衡量融合特征與編碼特征間的差異。此外,提出的網絡在偏振圖像數據集中進行訓練得到的模型,在其他模態圖像融合任務中仍具有較好的效果。

圖4 融合子網架構

2022年,提出一種基于像素信息引導和注意力機制的無監督偏振圖像融合網絡。將偏振圖像中需要融合的信息定義為高度偏振的目標信息和強度圖像的紋理信息,通過特別設計的損失函數約束不同圖像的像素分布,可以在像素級別上更好地保留不同類型的顯著信息,同時在融合模塊中引入注意力機制,有效解決了偏振信息和紋理分布不一致等問題。實驗證明,融合結果具有更豐富的偏振信息和更適宜的亮度。2023年,提出一種強度圖像和偏振度圖像的融合方法。通過編碼器提取源圖像的語義信息和紋理細節,并利用設計的加法策略和殘差網絡對圖像特征進行融合,同時提出改進的損失函數引導網絡訓練。

基于生成對抗網絡

2014年,Goodfellow等提出由生成器和鑒別器組成的生成對抗網絡。其中,生成器用于獲取數據分布,鑒別器能夠估計生成的數據是真實數據還是來自生成器。當生成器和鑒別器通過對抗博弈達到平衡狀態時,代表網絡訓練已完成。此時,生成器可以生成類似于真實分布中的樣本。2019年,將紅外圖像和可見光圖像的融合任務定義為生成器和鑒別器間的學習對抗,提出的FusionGAN能夠顯著增強融合圖像的紋理細節,同時為圖像融合領域開辟了新的研究思路。此后,基于GAN的圖像融合方法發展迅速,而為平衡圖像間的信息差異,一些方法開始構建具有雙鑒別器的生成對抗網絡結構,同時估計源圖像的兩個概率分布,用以獲得更好的融合效果。

2019年,提出一種能夠學習和分類源圖像特征的生成對抗網絡,相較于其他對比算法,提出網絡在視覺質量和整體分類精度方面具有更好的性能。2022年,提出一種生成對抗融合網絡用以學習偏振信息與物體輻射度之間的關系,并以實驗證明了將偏振信息引入基于深度學習方法的圖像復原任務中的可行性,提出方法能夠有效地去除后向散射光,更有利于恢復物體的輻射亮度。同年,長春理工大學提出一種語義引導的雙鑒別器偏振融合網絡。提出的網絡由一個生成器和兩個鑒別器組成,雙流型結構的生成器能夠充分地提取特征,通過對各語義對象進行加權生成融合圖像。而雙鑒別器則主要用于識別偏振度和強度圖像的各種語義目標。此外,作者構建了一個偏振圖像信息量判別模塊,通過加權的方式指導圖像融合過程,能夠針對性地保留不同材料的偏振信息。實驗結果表明,融合網絡在視覺效果和定量指標都具有更突出的性能,同時有助于高級視覺任務性能的提升。

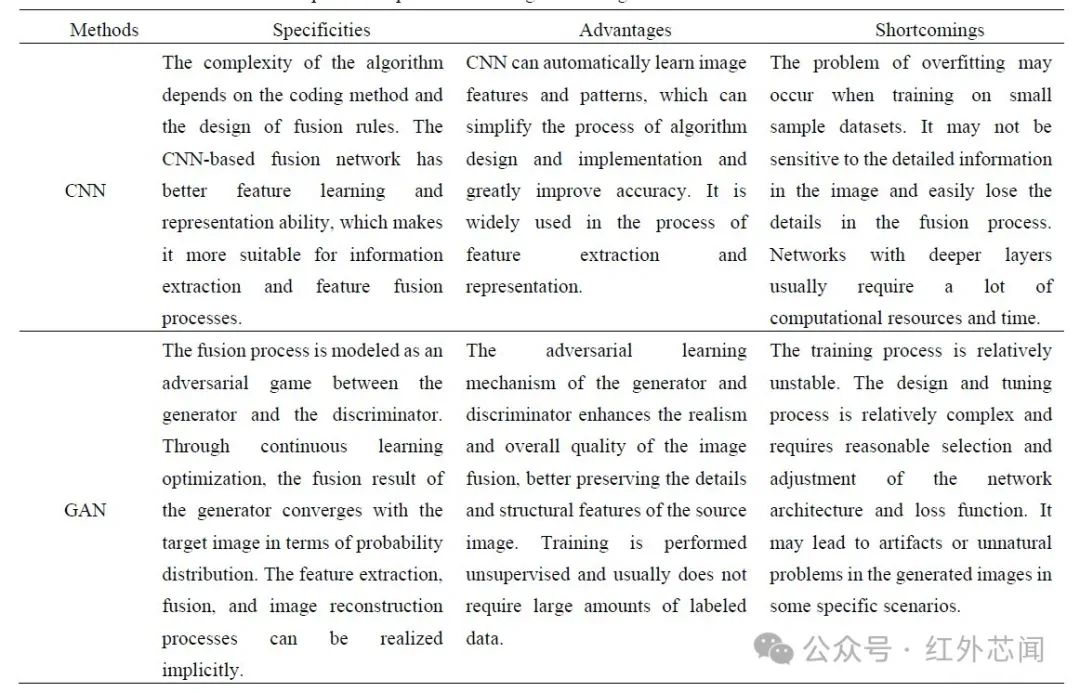

深度學習融合算法對比分析

基于CNN和GAN的偏振圖像融合算法具有不同特點,具體的對比分析如表2所示。

表2 基于CNN和GAN的偏振圖像融合算法對比

偏振融合應用

光譜信息和偏振信息的結合能夠更好地反映不同材質的特性,對于突出目標細節和改善視覺質量具有明顯的效果,有助于提高后續視覺任務的準確性和魯棒性。本章重點介紹偏振融合方法在目標檢測、語義分割、圖像去霧以及三維重建任務中應用。

目標檢測

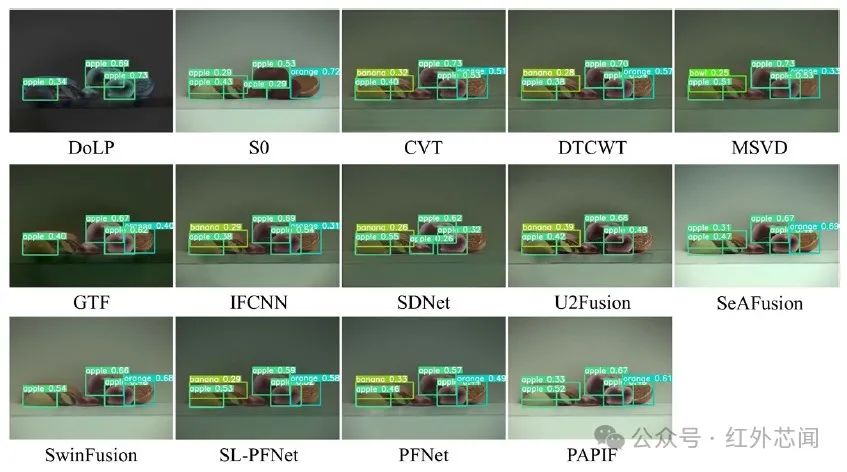

偏振圖像融合有利于提升目標檢測率。2020年,提出一種偏振圖像融合方法,通過偏振特征提取器和連續小卷積的深度卷積神經網絡有效提高了目標檢測的精度,并設計實驗證明提出網絡的檢測錯誤率低于傳統方法。2022年,利用YOLO v5s模型對源圖像進行目標檢測,并與11種對比方法進行比較,驗證了網絡的優越性以及目標檢測任務的提升,實驗結果如圖5所示。

圖5 目標檢測結果

語義分割

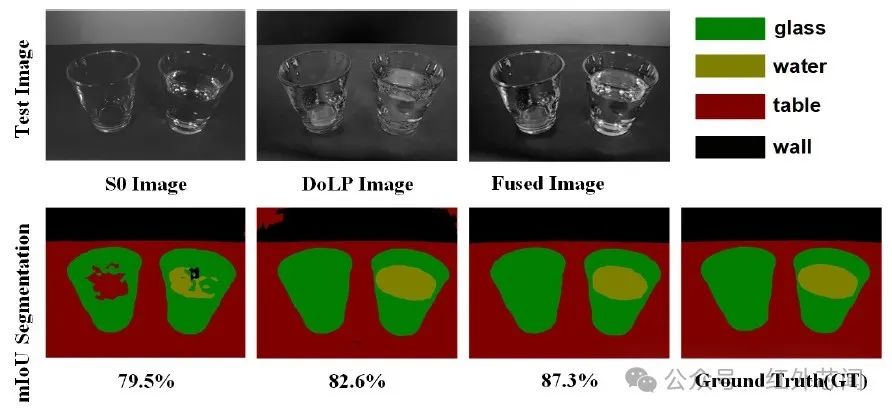

偏振圖像融合能夠有效提升語義分割任務的實驗效果。2019年,提出一種多階段復雜模態網絡,通過基于后期融合的網絡框架對RGB圖像和偏振圖像進行融合,充分提高了分割性能。2021年,提出一種注意力融合網絡,在充分融合源圖像信息的同時具有適應其他傳感器組合場景的靈活性,能夠顯著提升語義分割的精準度。2022年,通過實驗證明了融合偏振圖像在語義分割應用中的優勢性。作者利用DeepLabv3+模型對偏振強度圖像、線偏振度和融合圖像分別進行測試,發現融合圖像的分割精度相較于強度圖像提高7.8%,能夠實現更準確的分割效果,如圖6所示。

圖6 語義分割結果

圖像去霧

在圖像去霧的研究領域,結合偏振信息可以幫助恢復圖像的透射率和深度信息,有利于提升去霧效果。2018年,提出一種多小波融合的偏振探測去霧方法,將高低頻系數分別按照不同規則進行融合,突顯了目標輪廓和細節信息。實驗結果表明,在實際煙霧環境下,提出方法在視覺效果和客觀評價方面具有更多優勢,能夠提升霧天環境的目標識別效率。2021年,針對遠場密集霧霾天氣的去霧任務,提出一種基于空間頻分融合的偏振去霧方法,得到較為理想的實驗效果。同年,提出一種基于多尺度奇異值分解的偏振圖像融合去霧算法,通過驗證實驗和量化評價證明算法具有較強的自適應性和魯棒性,能夠有效地改善光暈和過曝光等問題。

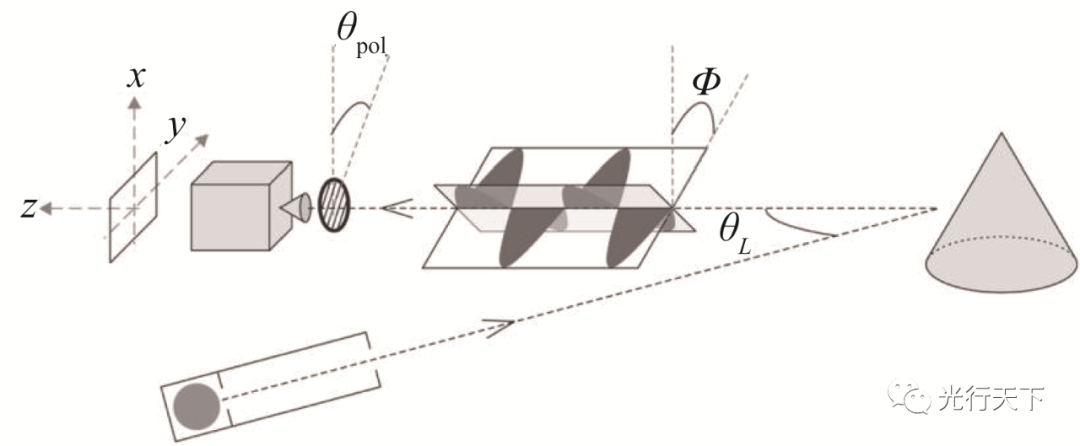

三維重建

在三維重建的研究領域,偏振維度信息提供的紋理和形狀信息有利于改善三維重建效果,同時對法向量估計任務也具有重要作用。2020年,將偏振形狀問題與深度學習結合,通過將物理模型融入神經網絡架構,使實驗結果在每個測試條件都達到最低的測試誤差。2021年,利用深度學習網絡克服了偏振法線計算中的角度模糊性問題,通過將優化后的偏振法線與圖像特征進行融合,實現了高精度的物體表面法線估計。2022年,提出一種融合偏振和光場信息的低紋理目標三維重建算法。通過融合目標物表面的光場信息與反射光的偏振信息用以增加圖像信息維度,解決了入射面方位角歧義性問題。

偏振圖像數據集

基于深度學習的偏振圖像融合網絡依賴于高質量的數據集,偏振圖像數據集的質量和數量很大程度上影響著網絡的訓練效果。目前,已有的公開高質量偏振圖像數據集仍相對較少。為此,一些國內外研究團隊慷慨地公開了各自建立的數據集,為相關領域研究做出寶貴貢獻。

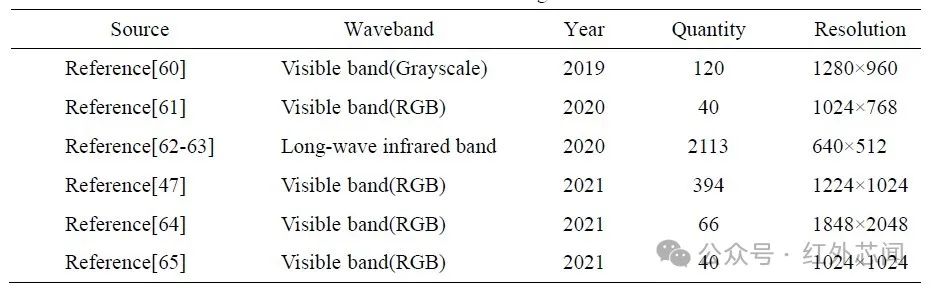

2019年,拍攝一個包含120組圖像的偏振數據集,每組數據由偏振角度為0°、45°、90°和135°的強度圖像組成。2020年,東京工業大學公開了一組包含40個場景的全彩色偏振圖像數據集,每組由4幅不同偏振角度的RGB圖像組成。同年,采用自行研制的非制冷紅外DoFP相機進行拍攝,公開由2113張標注圖像組成的長波紅外偏振數據集,包括白天和晚上的城市道路和高速公路場景。

2021年,浙江大學研究團隊針對校園道路場景建立一個共計394幅標注像素對齊的彩色偏振圖像數據集,包含RGB圖像、視差圖像和標簽圖像;中南大學拍攝一個由66組偏振圖像組成的數據集,包括各種建筑、植物和車輛等物體;阿卜杜拉國王科技大學公開一個包括40幅彩色圖像的偏振數據集,每個場景包含4幅不同偏振角度的強度圖像。上述偏振圖像數據集的簡要介紹如表3所示。

表3 偏振圖像數據集

總結與展望

目前,偏振圖像融合領域正在受到越來越多的關注和研究。通過將不同光譜、模態圖像與偏振圖像進行融合,可以實現不同優勢信息的有效互補。深度學習融合方法在一定程度上彌補了傳統融合方法的局限性,表現出其獨特優勢,在主觀評價和客觀分析方面都具有較為突出的表現,已成為偏振圖像融合領域的主要研究方向。然而,當前的深度學習偏振融合方法仍相對較少且大部分僅是對現有深度網絡的直接利用或簡單改進,缺少從偏振成像原理和物質偏振特性進行深入分析,在基礎理論研究、技術應用以及實驗驗證等方面都存在較大的提升空間,需要在以下幾個方面進一步探索和突破:

①利用目標與背景間的偏振特性差異構建偏振二向反射模型(pBRDF),分析目標偏振成像與傳輸介質的相互作用關系,并構建起偏-傳輸-探測的全鏈路光學成像模型,進而實現更好的偏振特征提取與圖像融合。

②深入研究目標偏振特性及其表征方法,充分發揮深度學習的優勢,并挖掘偏振的非物理特征和深度特征。將偏振光學特性應用于圖像融合過程,同時將傳統融合方法與深度學習融合方法相結合,實現更理想的特征級偏振圖像融合。

③由于深度學習融合網絡訓練通常依賴大數據,而目前公開的高質量偏振圖像數據有限,所以應推進偏振多光譜圖像數據集的信息共享,并針對性地提出具有小樣本訓練能力的深度學習融合網絡。

④充分結合不同模態圖像的優勢信息,探索多源圖像融合新方式,實現光強、光譜和偏振的信息互補,提升融合性能,同時為圖像分割分類和目標檢測識別等視覺任務提供基礎支撐。

審核編輯:黃飛

?

電子發燒友App

電子發燒友App

評論